Von On-Premise bis in die Cloud (2/2)

Maschine – Cloud, Cloud – Maschine

Die meisten Fertigungsunternehmen wählen für ihren Weg ins Internet of Things ein skalierbares Vorgehen. Zwei Varianten für einen solchen Einstieg beschreibt der erste Artikel dieses Zweiteilers. In diesem Artikel stehen drei komplexere Cloudszenarien am Beispiel von Microsoft Azure samt PaaS-Ressourcen im Mittelpunkt.

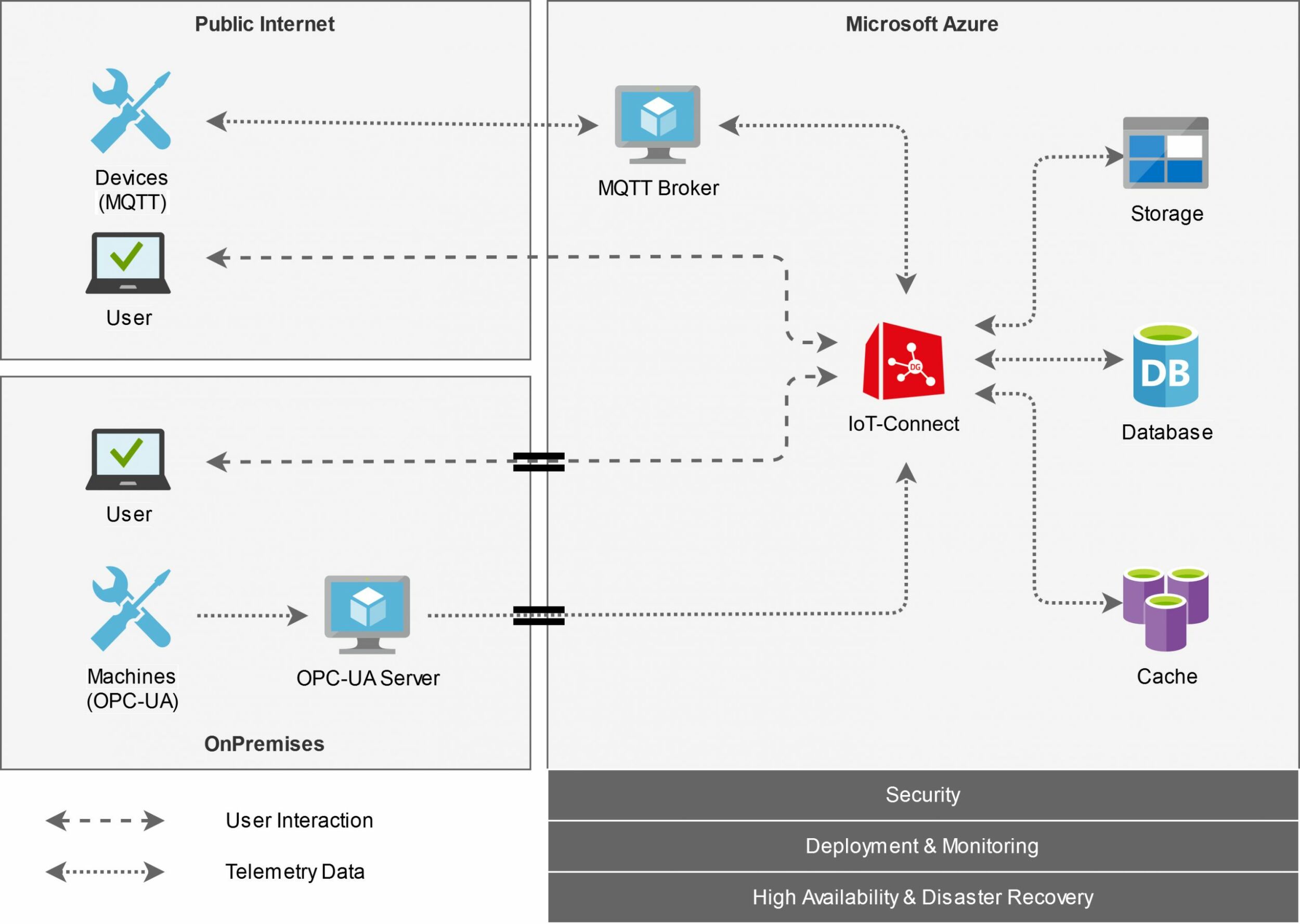

Im ersten Teil wurde ein IoT On-Premise-Szenario für IoT und eine vom Aufbau her ähnliche einfache Cloudlösung skizziert. Ausgangspunkt aller hier vorgestellten Szenarien ist dabei der Einsatz des von Datagroup Ulm entwickelten IoT Connectors. Bei dem einfachen Cloud-Szenario aus dem ersten Teil lief der IoT Connector in Docker-Containern innerhalb einer Virtual Machine (VM), die als Infrastructure as a Service (IaaS) in einer Cloudumgebung vorgehalten wurde. Die nun folgenden Varianten zeigen den Einsatz des IoT Connectors in Azure, wobei verschiedene Platform as a Service(PaaS)-Ressourcen verwendet werden.

Mehr Azure-Ressourcen nutzen

Das dritte Szenario einer erweiterten Cloudanbindung empfiehlt sich eher für IoT- und clouderfahrene Unternehmen oder solche, die durch externe Experten unterstützt werden. Denn hier bindet sich das Unternehmen stärker an eine Cloudlösung und einen Cloud Provider. Dieses Szenario bietet allerdings leistungsfähigere Funktionalitäten und Vorteile gegenüber einfachen Cloudszenarios. Kern der Architektur ist weiterhin der IoT Connector, der in diesem Beispiel durch einen AppService gekapselt wird. Die bisher containerbasierten Komponenten – Datenbank, In-Memory-Cache und Datenspeicher – werden nun von Azure als PaaS-Ressourcen bereitgestellt, ebenso die VM für den MQTT-Server (IaaS), der die Übertragung der Telemetriedaten ermöglicht – natürlich wird alternativ auch OPC-UA als Standard unterstützt. SAP-Verantwortliche wissen, dass sie handeln müssen – aber nicht, wie sie fundiert entscheiden. ‣ weiterlesen

SAP-Transformation mit Augenmaß: Sicherheit für die richtige Entscheidung

VM ohne Administrator

Dieses Vorgehen hat einige Vorteile. Anders als beim einfachen Cloudszenario ist keine Adminstration der VM nötig, wenn der MQTT-Server außerhalb von Azure läuft. Läuft er hingegen auf Azure, ist eine Administration der VM nötig, allerdings wesentlich weniger als im vorherigen Szenario, da Datenbank, Storage und Cache PaaS-Dienste sind. Da die Datenbanken, der Cache und so weiter von Azure bereitgestellt werden, ist die Software zudem stets auf dem aktuellen Stand etwa bezüglich Betriebssystem und Virenscanner. Überwacht wird das System ebenfalls über Azure. Durch die Cloudplattform ist die Erreichbarkeit der Ressourcen sichergestellt. Weitere Azure-Ressourcen lassen sich so später leichter integrieren und einzelne Dienste leichter skalieren.

Nah an der Referenzarchitektur

Das vorherige Szenario kann seine strukturelle Nähe zum einfachen Cloudszenario nicht verleugnen. Von der Referenzarchitektur von Azure für IoT-Lösungen ist es aber noch ein gutes Stück entfernt. Dem nähert sich das nun folgende Szenario. Der Azure IoT-Hub wird hier als Tor für die Telemetriedaten genutzt, die von den Maschinen in die Cloud gesendet werden, Ingress. Das und die Verwendung von Stream Analytics verbessert die Skalierbarkeit der Lösung. Die Maschinendaten werden ohne Verarbeitung durch den IoT Connector in einer Azure-Datenbank abgelegt – allerdings werden diese in der Regel durch Azure oder Azure-Ressourcen vorverarbeitet. Um die Daten etwa durch Machine Learning weiterverarbeiten zu können, werden die Rohdaten in der Cloud abgelegt. Externe Schnittstellen lassen sich über Logic-Apps anbinden, wobei deren Verwendung und Integration stark vom jeweiligen Unternehmenssystem abhängt. Die Geräteverwaltung sowie die Visualisierung der Messwerte finden weiterhin im IoT Connector statt. Das Alarming, etwa bei einer Schwellwert-Überschreitung, erfolgt jedoch über Azure Functions.

Weg frei für Machine Learning

Das letzte Szenario baut auf dem vierten auf, ist aber komplexer. Laufen bisher die Daten nur in eine Richtung, Device to Cloud, erfolgt im letzten hier vorgestellten Szenario die Kommunikation bidirektional. Da die Maschinen nun auch aus der Cloud heraus gesteuert werden können, braucht es einer stärkeren Sicherung. Die bidirektionale Kommunikation ermöglicht per Device Twins die Parameter der Devices abzufragen und zu setzen. Auch Aktionen und Software-Updates können nun aus der Ferne ausgeführt werden. Um die Verarbeitung auch großer Datenmengen zu ermöglichen, liegen die Telemetriedaten in einer NoSQL-Datenbank. Die Daten des IoT Connectors, die keine Telemetriedaten sind, liegen weiterhin auf einer relationalen SQL-Datenbank. Die Rohdaten, die etwa Grundlage für den Einsatz von Machine Learning sind, liegen wie im vorherigen Szenario auf dem Blob Storage. Die Möglichkeiten zur Visualisierung der Telemetriedaten im IoT Connector können durch die Einbindung weiterer Tools wie Time Serie Insights, Power BI oder Grafana erweitert werden. Mobile Apps lassen sich zur Ausgabe bestimmter Daten oder zur Alarmierung nutzen. Zum Schutz dieses IoT-Szenarios lässt sich die Benutzerverwaltung in die universelle Identitätsplattform Azure Active Directory ausgelagern und eine mehrstufige Authentifizierung (Multi-Factor Authentication) umsetzen.

Für komplexere Use-Cases

Die im letzten Szenario skizzierte Architektur lässt auch die Umsetzung komplexerer IoT-Use Cases zu – durch die bidirectionale Kommunikation zwischen Device und Cloud sowie die stärkere Integration in die Azure-Ressourcen und das Azure-Umfeld. Die Skalierbarkeit der Lösung kann noch einmal gezielter in einzelnen Services erfolgen. Um die Lösung in Betrieb zu nehmen, wird allerdings IoT-Erfahrung oder das Expertenwissen eines erfahrenen Dienstleisters benötigt.

In Etappen ans Ziel

Alle Szenarien zeigen, dass ein skalierbares Vorgehen bei IoT-Projekten ratsam ist. Mit einem IoT lassen sich bereits im On-Premise-Betrieb nützliche Effekte erzielen, die später in Verbindung mit einer Cloud erweitert werden können. Nicht zu unterschätzen ist dabei die Komplexität der Lösungen. Ihre Umsetzung und ihr Einsatz in der Praxis erfordern ein umfassendes technisches und organisatorisches Knowhow sowie eine ausgedehnte Datenanalyse.