Das Konzept der ‚Master Data Quality Gates‘

Tore zu besserer Stammdatenqualität

Das Konzept der ‚Master Data Quality Gates‘ soll in Unternehmen für stets korrekte Stammdaten sorgen. Im Kern werden dabei die Daten kontinuierlich und automatisch kontrolliert, statt etwa vor einem Softwareprojekt aus dieser Aufgabe jedes Mal ein Großprojekt zu machen.

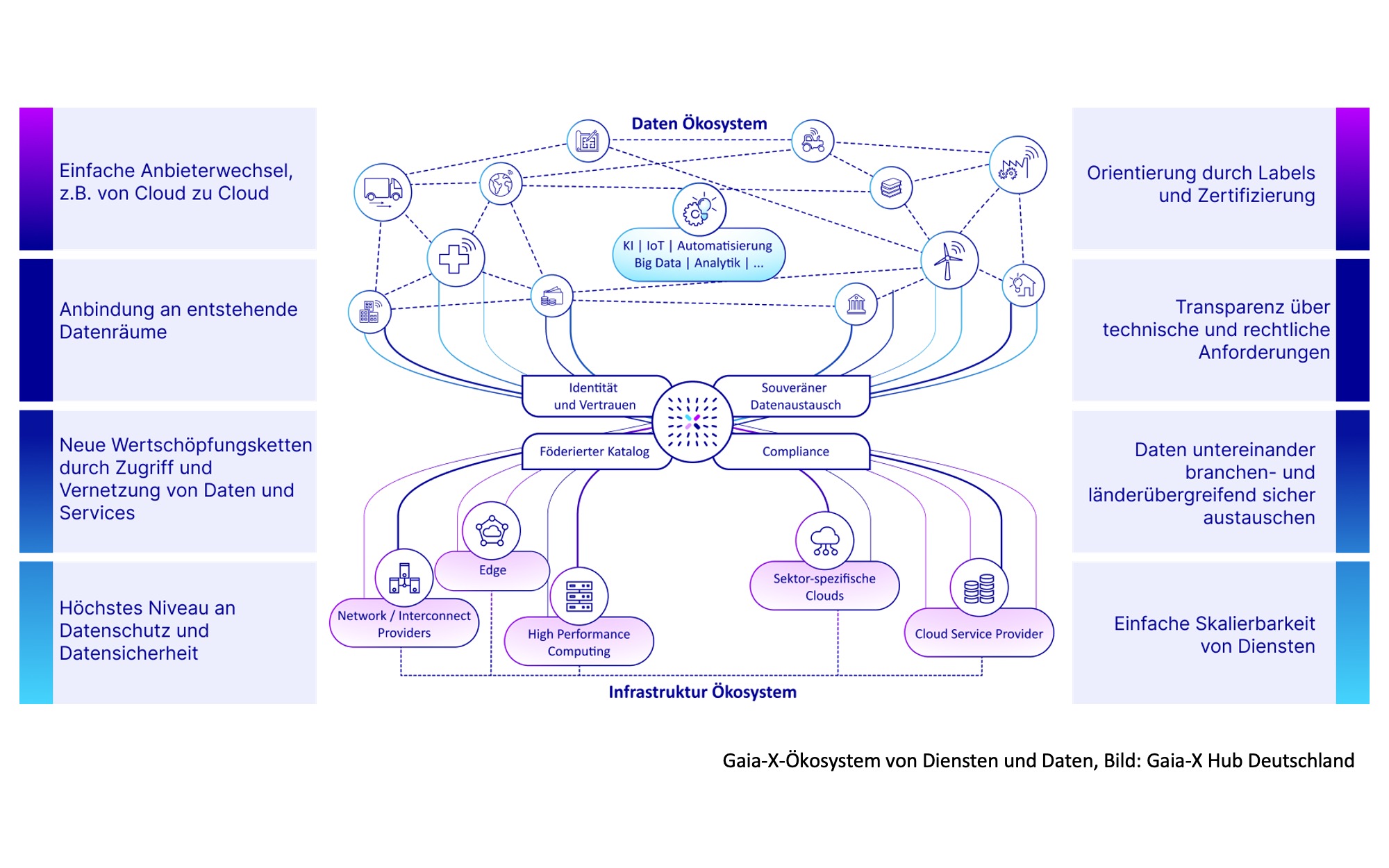

Kaufleute und Ingenieure legen ähnliche Maßstäbe an die Qualität von Informationen an: Sie beginnen mit Aktualität, Richtigkeit und Vollständigkeit. Diese Kriterien gelten ohne Einschränkungen auch für Stammdaten, die wir in unsere digitalen Informationsspeicher laden, damit sie von Software-gesteuerten Prozessen weiterverarbeitet werden. Doch allein reichen diese Kriterien nicht aus: Nur eine Konformität der Daten mit spezifischen Regeln lässt eine maschinelle Verarbeitung zu. Einzelne Systeme verweigern den Dienst, wenn z.B. ein Datumswert in falschem Format eingegeben wird. Werden mehrere Systeme verwendet, müssen die Konventionen angepasst werden, damit sie für alle einheitlich gelten. Eine länderübergreifende Nutzung, in Zeiten der Globalisierung die Regel, erfordert Ergänzungen der geltenden Zeitzone und Maßeinheiten. Die Daten in den verschiedenen Systemen müssen widerspruchsfrei sein, also konsistent sein. Dies wird erleichtert, wenn die Daten einzigartig sind: Dubletten blähen nicht nur den Datenbestand unnötig auf. Sie sorgen für Mehraufwand, bilden eine potenzielle Fehlerquelle und verursachen Verschwendung, die schwer zu eliminieren ist. Digitale Technologien wie künstliche Intelligenz verlangen zu den anderen Qualitätsmerkmalen eine möglichst hohe Genauigkeit. Diese bezieht sich nicht nur auf die Nachkomma-Stellen von Zahlenwerten, sondern etwa auch auf sprachlich präzise Textinformationen. Dann dürften digitale Assistenten und automatische Sprachübersetzer bald auch in der Automatisierungstechnik anzutreffen sein. Die neunte Ausgabe von Rockwell Automations „State of Smart Manufacturing“ Report liefert Einblicke in Trends und Herausforderungen für Hersteller. Dazu wurden über 1.500 Fertigungsunternehmen befragt, knapp 100 der befragten Unternehmen kommen aus Deutschland. ‣ weiterlesen

KI in Fertigungsbranche vorn

Datenqualität als Projektarbeit

Bisher wurde die Qualität von Stammdaten vor allem dann überprüft und angepasst, wenn die Konformität mit neuen oder fremden Systemen hergestellt werden musste. Bei Generationswechseln von ERP-Systemen etwa wurden entweder umfangreiche Projekte zur Strukturierung und Bereinigung der Stammdaten durchgeführt – oder die Datenbasis weitgehend neu angelegt. Die Verknüpfung von ERP- und PLM-Systemen erforderte Bemühungen zur Klassifizierung und Vereinheitlichung von Geometriedaten in 3D-Modellen und Zeichnungen sowie beschreibenden Daten. Schließlich bildeten Firmenübernahmen einen wichtigen Anlass, um die Stammdaten auf eine Verwendung in den Systemen der neuen Muttergesellschaft vorzubereiten. Der Aufwand, den diese anlassbezogenen Projekte für das gesamte Unternehmen bedeuten, bleibt trotz externer Beratung und leistungsfähiger Tools erheblich. Noch gravierender scheint aber, dass dieses projektbezogene Stammdaten-Management die Digitalisierungsbemühungen eines Unternehmens konterkarieren kann. Je mehr Daten Unternehmen aus externen Quellen beziehen, in unterschiedlichen Systemen verarbeiten und sie für die Steuerung von internen und externen Prozessen nutzen, umso wichtiger wird die Überprüfung der Datenqualität an verschiedenen Schnittstellen. Denn Fehler in in Konsistenz und Genauigkeit von Daten können unvorhersehbare Folgen haben. Der Thin[gk]athon, veranstaltet vom Smart Systems Hub, vereint kollaborative Intelligenz und Industrie-Expertise, um in einem dreitägigen Hackathon innovative Lösungsansätze für komplexe Fragestellungen zu generieren. ‣ weiterlesen

Innovationstreiber Thin[gk]athon: Kollaborative Intelligenz trifft auf Industrie-Expertise

Ständige Prüfung und Korrektur

Um diese Prüfarbeit zu automatisieren und an verschiedenen Punkten in der Unternehmens-IT einzurichten, wurde das Konzept der ‚Master Data Quality Gates‘ entwickelt. Statt anlassbezogener oder periodischer Maßnahmen zur Qualitätsverbesserung werden hierbei prozessrelevante Daten an verschiedenen Punkten permanent überprüft und nach Möglichkeit automatisch korrigiert. Nur wenn sie die Regeln und speziell definierten Kriterien erfüllen, gelangen sie in den Prozess. Die Idee dahinter stammt aus dem Projektmanagement. Dort lösen Quality Gates, die Projektfortschritte anhand zuvor festgelegter, qualitativer Kriterien messen, in analoger Weise die als Meilensteine gesetzten Termine ab. Der Projektfortschritt wird nicht mehr zeitlich definiert, sondern die Erfüllung qualitativer Aspekte leitet neue Phasen ein. Diese werden in verbindlichen Qualitätskriterien vor Beginn der Phasen festgelegt. Damit wird das Datenmanagement wesentlich flexibler: Die genauen Anforderungen an die Beschaffenheit der Daten sollten sich je nach Abteilung und Prozess einstellen lassen. Welche Kriterien müssen Arbeitspläne einhalten, wenn sie von der Arbeitsvorbereitung im ERP-System aufgebaut werden? Welche Informationen liefert welche Abteilung in welcher Form zu einem automatisierten Materialstamm-Anlageprozess? Jedes Unternehmen muss selbst bestimmen, mit welchem Fortschrittsstatus ein Datensatz an den nächsten Prozessschritt weitergegeben wird. Das Konzept der IT-basierten Quality Gates scheint geeignet, Qualitätsmängel von Stammdaten bei überschaubarem Aufwand in den Griff zu bekommen – mit Kontinuität und automatischen Korrekturmechanismen.