Parameter für Datenqualität

Datengüte im ERP-System messen und verbessern

Gerade in einer wirtschaftlichen Flaute sollten Unternehmen ihre Position sichern, stärken, neue Angebote entwickeln und bestehende verbessern. Eine gute Datenbasis sorgt dafür, das die Geschäftsprozesse reibungsarm ablaufen und Manager gute Entscheidungen treffen. Doch wie misst man die Güte der Systemdaten?

Mit einem siebenstufigen Leistungstest lassen sich gute von schlechten Daten etwa im Enterprise Resource Planning-System (ERP) unterscheiden. Unabhängig davon, ob es sich um eigene oder um Informationen aus anderen Quellen handelt, etwa von Wirtschaftsauskunfteien und anderen Drittanbietern. Im Folgenden werden die entscheidenen Parameter dargelegt.

Vollständige Daten

Je digitalisierter Abläufe werden, umso wichtiger ist es, dass alle benötigen Daten vorliegen. Sind beispielsweise Angaben zu Bauteilen für ein Produkt unvollständig, kann der Produktionsprozess stocken oder das Endprodukt entspricht nicht den Vorgaben. Deshalb empfehlen sich die Definition von Pflichtfeldern sowie automatisierte Prüfungen an ausgewählten Prozesspunkten. Unternehmen sollten dabei auf Datensparsamkeit achten. Denn bei personenbezogenen Daten gilt es, spätestens seit Inkrafttreten der Datenschutzgrundverordnung (DSGVO), nur Informationen zu speichern, die tatsächlich nötig sind. Nicht erforderliche Daten sind dauerhaft zu löschen. Die neunte Ausgabe von Rockwell Automations „State of Smart Manufacturing“ Report liefert Einblicke in Trends und Herausforderungen für Hersteller. Dazu wurden über 1.500 Fertigungsunternehmen befragt, knapp 100 der befragten Unternehmen kommen aus Deutschland. ‣ weiterlesen

KI in Fertigungsbranche vorn

Aktuelle Daten

Nicht-synchronisierte Adress- und Kontaktdaten sind ein Paradebeispiel für veraltete Informationen. Vertriebsmitarbeiter sind oft nur sporadisch in der Zentrale, deshalb ist die Kundendatenbank selten ganz aktuell. Mobile CRM-Lösungen können helfen. Außerdem halten sie produktionskritische Informationen wie Lagerdaten auf Stand. Dennoch muss nicht alles in Echtzeit vorliegen. Unternehmen sollten vielmehr ihre Prozesse so ausrichten, dass die Daten dort am schnellsten aktualisiert werden, wo das für mehr Produktivität sorgt. Der Thin[gk]athon, veranstaltet vom Smart Systems Hub, vereint kollaborative Intelligenz und Industrie-Expertise, um in einem dreitägigen Hackathon innovative Lösungsansätze für komplexe Fragestellungen zu generieren. ‣ weiterlesen

Innovationstreiber Thin[gk]athon: Kollaborative Intelligenz trifft auf Industrie-Expertise

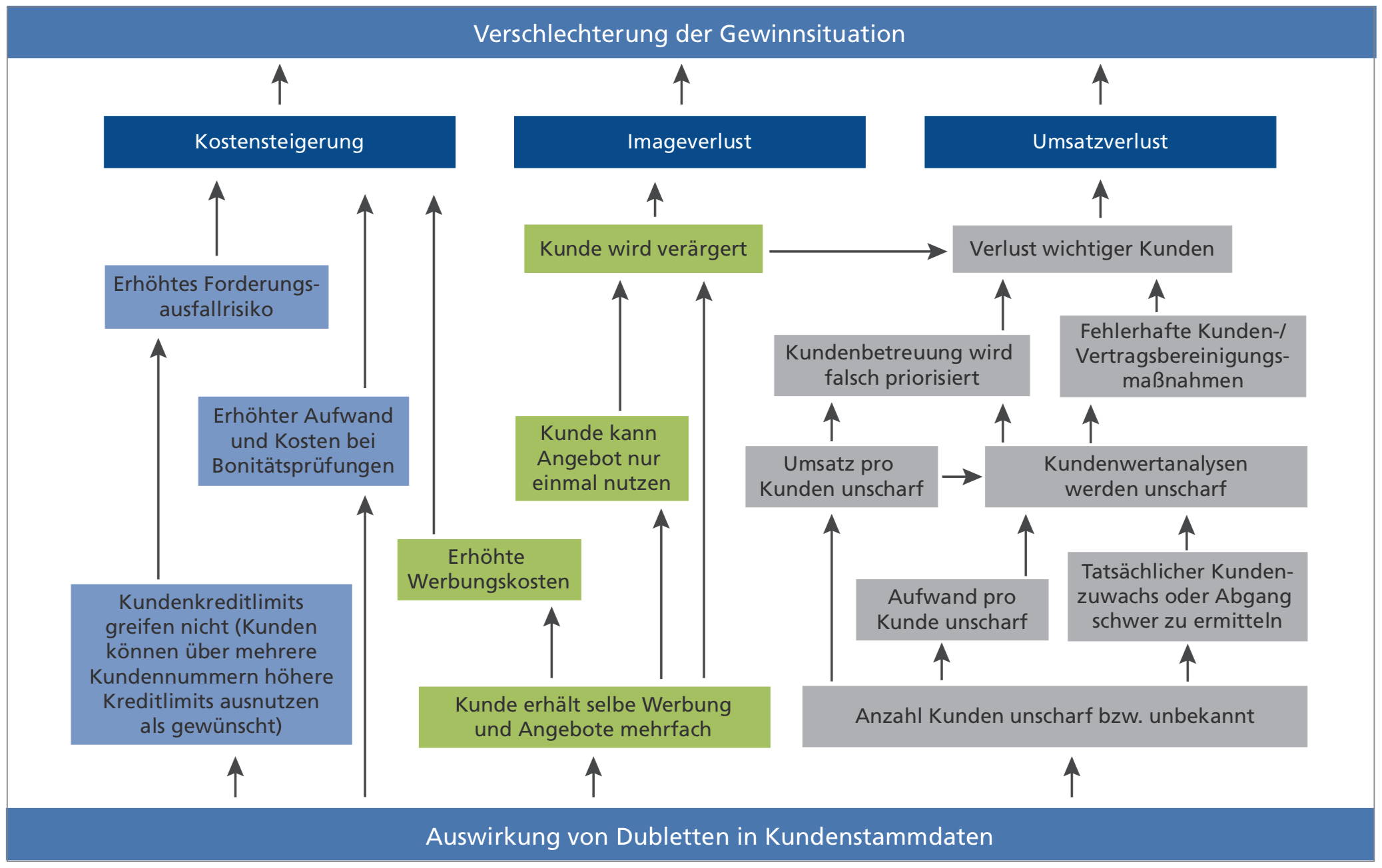

Konsistente Daten

Datensätze müssen auch in verschiedenen Systemen konsistent sein. Die doppelte Datenhaltung in mehreren Anwendungen ist oft nicht nur ein Mehraufwand für die Dateneingabe, sondern auch fehleranfällig. Eine Fehlerquelle könnte der Übertrag der Auftragsdaten in eine Software zur Qualitätssicherung sein. Daraus resultierende Inkonsistenzen sind mit moderner Integrationstechnik relativ einfach in den Griff zu bekommen.

Konformität

Daten müssen den Anforderungen der Systeme und der Prozesse entsprechen, etwa im passenden, möglichst standardisierten Format vorliegen. Beispiele sind Datums- und Währungsformate. Bei Zeitstempeln ist ferner darauf zu achten, dass zusätzlich zu Stunden und Minuten auch die jeweilige Zeitzone miterfasst wird.