Predictive Costing

Wann kann die KI Kosten kalkulieren?

Weltweite Machtverschiebungen, Strafzölle und gekündigte Handelsabkommen – Produktkosten früh zu berechnen, ist schwer wie selten zuvor. Doch klaffen tatsächliche und kalkulierte Rohstoffpreise zu weit, leidet die Profitabilität. Künstliche Intelligenz in Verbindung mit einer Software für das Product Costing könnten hier den Weitblick verschaffen, der manchem politischen Akteur abzugehen scheint.

Technologische Entwicklungen, etwa im Bereich der künstlichen Intelligenz, haben das Potenzial, die Risiken volatiler Weltmärkte zu reduzieren, indem Kosten beeinflussende Veränderungen früh antizipiert werden. Entscheidungen auf Basis statischer Analysen zu treffen, ist in einer digitalisierten Wirtschaft, in der Vernetzung, Echtzeitdaten und Automatisierung immer wichtiger werden, oft nicht mehr zielführend. Das hohe Datenaufkommen macht Analysen komplexer. Hier können KI-Lösungen zum Einsatz kommen, da sie sehr gut wiederholende Tätigkeiten übernehmen können. So wird etwa künftig das Stammdatenmanagement im Einkauf von KI abgedeckt oder der Abgleich eines Vertrags mit den Rechnungen von intelligenten Algorithmen übernommen. Die gesamten Abläufe im Unternehmen werden sich verändern, weil KI die digitalen Geschäftsprozesse vorantreibt – so auch im Kostenmanagement: Predictive Costing, also ‚vorausschauende Kostenkalkulation‘ mit künstlicher Intelligenz, vereinfacht künftig Entscheidungen für eine schnelle Preiskalkulation und -anpassung.

Von Science-Fiction zur Produktkostenkalkulation

Wenn man mit dem Begriff künstliche Intelligenz konfrontiert wird, denken viele wahrscheinlich zunächst an den Kino-Androiden Terminator oder den ‚menschlichen‘ Computer HAL 9000 aus dem Film ‚2001: Odyssee im Weltraum‘. Unmittelbar danach kommen vielen autonome Fahrzeuge, (mit-)denkende Roboter oder vielleicht Predictive Maintenance in den Sinn. Im Zusammenspiel mit den richtigen Daten kann künstliche Intelligenz aber noch viel mehr: etwa die Automatisierung von Geschäftsprozessen. Der Hersteller von Product-Costing-Software Facton geht davon aus, dass dies auch die Produktkostenkalkulation beeinflussen wird.

Zwei Anwendungsfälle

Globale Verflechtungen und disruptive, technologische Neuerungen verkomplizieren Kostenstrukturen und begünstigen Kostentreiber. Deren Abschätzung und Bewertung ließe sich bei den folgenden beiden Anwendungsfällen mit Predictive Costing deutlich verbessern: Die neunte Ausgabe von Rockwell Automations „State of Smart Manufacturing“ Report liefert Einblicke in Trends und Herausforderungen für Hersteller. Dazu wurden über 1.500 Fertigungsunternehmen befragt, knapp 100 der befragten Unternehmen kommen aus Deutschland. ‣ weiterlesen

KI in Fertigungsbranche vorn

Frühzeitige Kostenschätzung (Quick Estimation Module): In einem frühen Projektstadium braucht man eine schnelle Kostenschätzung, ohne eine detaillierte Kostenaufstellung der Fertigungsstückliste vorzunehmen. Nur so können Kostentreiber rechtzeitig erkannt und ausgeschaltet werden. Ein Quick Estimation Module basiert auf intelligenten Algorithmen und bestimmt anhand existierender Unternehmensdaten sowie weiterer Parameter die Produktionskosten. Die Anwendung wird als künstliches, neuronales Netz konzipiert und anhand vorgegebener Beispieldaten trainiert. Das Modul ermöglicht es, Produktstück- oder Fertigungskostenkosten im Design Costing anhand einfacher Parameter zu schätzen und Alternativbewertung sowie Kostenstrukturen transparent darzustellen, ohne eine detaillierte Analyse durchzuführen.

Ausreißer-Analyse in Echtzeit: Global agierende Unternehmen standardisieren ihre Ansätze zur Kostenschätzung so weit wie möglich. Sogenannte Ausreißer bezeichnen einen Datenpunkt, dessen Eigenschaften stark von der Norm abweichen. In Unternehmen kommen Ausreißer bei Kostenschätzungen immer wieder vor, sie sind allerdings bei großen Datenmengen manuell kaum zu erfassen. Mit der intelligenten Ausreißer-Analyse wird ein Werkzeug zur Verfügung gestellt, um die Kostendatenbank des Unternehmens entweder strukturell oder kostenmäßig zu analysieren. So werden Kostenstellen identifiziert, die außerhalb des Standards liegen bzw. nicht den Best Practices entsprechen. Dabei untersuchen Machine Learning-Algorithmen die Daten. Über die Verbindung mit einer automatisierten Echtzeitanalyse werden Ausreißer in einer Kostenschätzung direkt aufgedeckt.

Kalkulation digitalisieren

Damit künstliche Intelligenz irgendwann einmal in der Produktkostenkalkulation eingesetzt werden kann, gilt es bestimmte Voraussetzungen zu erfüllen, wie die Standardisierung und Digitalisierung der Produktkostenkalkulation. Im Gegensatz zur Buchhaltung gibt es in der Produktkostenkalkulation keine Standards. Die braucht es aber, um Daten einheitlich zu berechnen, um aus verschiedenen Quellen sinnvoll zu kombinieren und für eine KI-Technologie zu nutzen. Die Digitalisierung der Kostenkalkulation ist damit eine zentrale Voraussetzung für ein Predictive Costing. Product Costing-Software bietet dafür eine gute Grundlage. Damit lässt sich schon heute ein Kostenmanagement zur unternehmensweit einheitlichen und transparenten Produktkostenkalkulation über den gesamten Lebenszyklus eines Produkts digital unterstützen. Unternehmen können auch ihre ERP- oder PLM-Systeme zur Produktkalkulation nutzen. Dann müssen zunächst die kostenrelevanten Daten, soweit überhaupt vorhanden, aus den unterschiedlichen Quellen konsolidiert werden. Ergebnisse bleiben dabei oft ungenau. Dedizierte EPC-Anwendungen sind darauf ausgelegt, Fallstricke wie diese systematisch zu umgehen. Und sie könnten in Zukunft noch intelligenter werden. Der Thin[gk]athon, veranstaltet vom Smart Systems Hub, vereint kollaborative Intelligenz und Industrie-Expertise, um in einem dreitägigen Hackathon innovative Lösungsansätze für komplexe Fragestellungen zu generieren. ‣ weiterlesen

Innovationstreiber Thin[gk]athon: Kollaborative Intelligenz trifft auf Industrie-Expertise

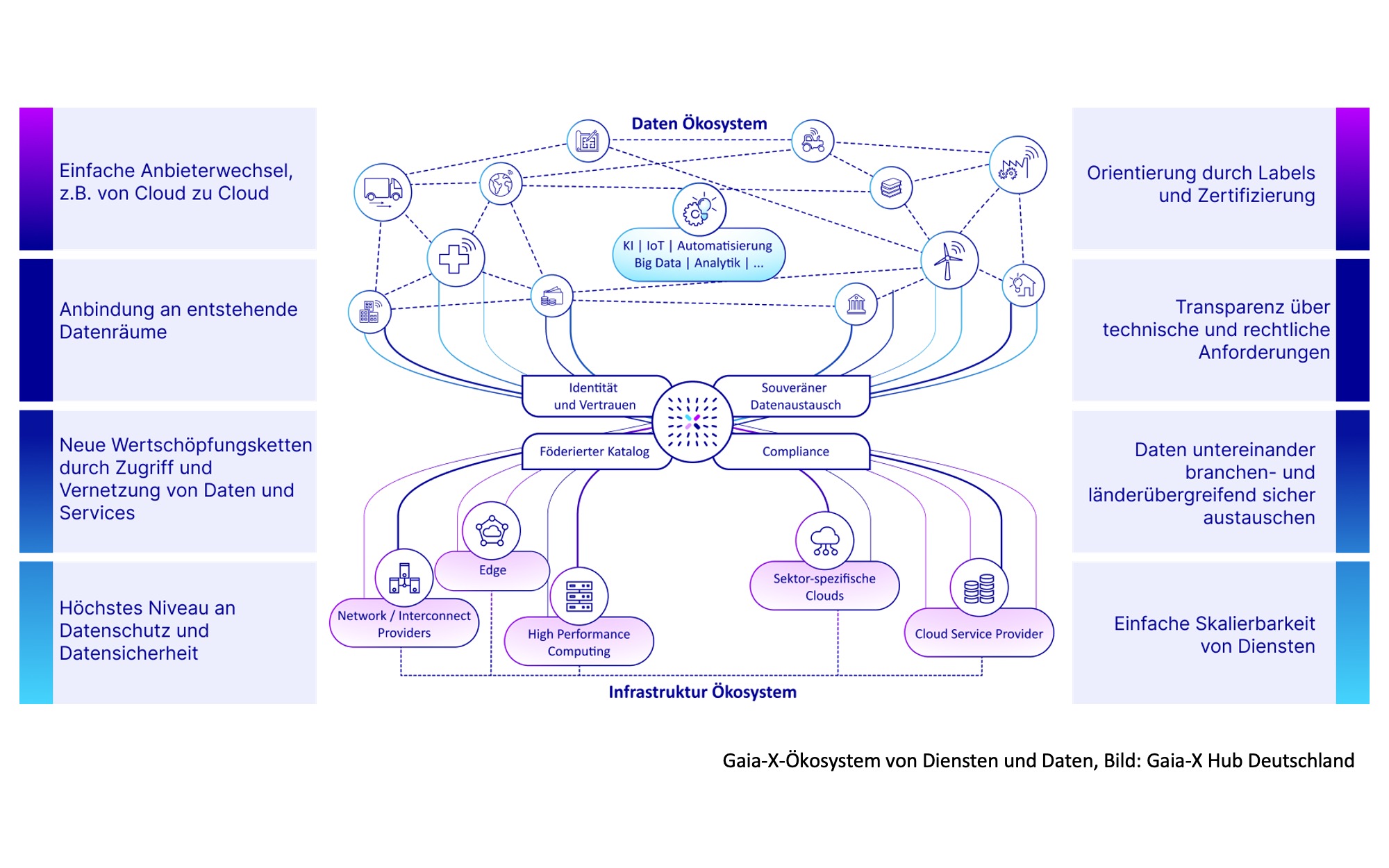

Umwege über die Cloud

Bevor sich die Daten einer Produktkalkulations-Lösung durch KI-Routinen bearbeiten lassen, müssen die Hersteller solcher Lösungen eine passende Plattform bereitstellen, also im Regelfall eine Cloud-Infrastruktur, auf der kalkulationsrelevante Daten umfassend und standardisiert zur Verfügung stehen. Die Entwicklung von KI-Lösungen oder die intelligente Erweiterung bestehender Anwendungen braucht Speicherplatz, Zugang zu Rechenleistung und Konnektivität, wie es fast nur per Cloud-Anbindung zu realisieren ist. Dies ermöglicht zudem eine flexible und skalierbare IT-Infrastruktur, die Anforderungen wie Services, Protokolle und Sicherheitsmechanismen gerecht wird.

KI und der Faktor Mensch

Trotz aller technischen Maßnahmen werden Algorithmen, die eine KI-Anwendungen bestimmen, ein Produkt menschlicher Berechnungen bleiben. Eine KI, wie Siri oder das Übersetzungstool Deepl, lernt z.B. aus solchen Algorithmen, geht jedoch auf unbekanntem Terrain verloren. Unbekanntes Terrain wird erreicht, wenn die verfügbaren Datenmengen nicht ausreichen oder weil es keine Datenvielfalt bei den Ausgangsdaten gibt. Das System ist also immer nur so gut, wie es gepflegt wird. Wird bei den Ausgangsdaten auf Datenvielfalt verzichtet oder sind die Daten nicht repräsentativ oder einseitig, werden Ergebnisse verzerrt. Für die Entwicklung von Algorithmen spielt daher der Mensch, der die Algorithmen schreibt, der Verwendungszweck und die Diversität der Ausgangsdaten eine entscheidende Rolle. Stetige Trainings und Schulungen für Menschen, die mit Algorithmen arbeiten, sensibilisieren für potentielle Verzerrungen. Künstliche Intelligenz wird eine noch breitere Akzeptanz in Gesellschaft und Wirtschaft erfahren, wenn Ergebnisse nachvollziehbar werden. Für die Automatisierung der Geschäftsprozesse, und so auch für die Kalkulation der Produktkosten, wird künstliche Intelligenz zur noch größeren Triebfeder, wenn die Entscheidungen in der KÍ-Anwendung erklärbar werden. Die sogenannte XAI (Explainable Artificial Intelligence) macht Entscheidungsprozesse nachvollziehbar. Ein Beispiel zur Erläuterung: Wer eine Person fragt, anhand welcher Parameter sie einen Gegenstand erkannt hat, bekommt eine klare Antwort. Nicht so innerhalb der IT: Ein Computer nennt mithilfe der KI den erkannten Gegenstand, nicht aber die Erklärung, anhand welcher Faktoren der Gegenstand identifiziert wurde. XAI lernt, handelt und entscheidet nicht nur selbstständig, sondern erläutert auf welchen Merkmalen basierend es seine Entscheidung zur Identifizierung gestützt hat. Die Beantwortung der Frage nach dem Warum ist ein erheblicher Mehrwert für Unternehmen, weil auf die Systematik einer Black Box verzichtet wird und es nachvollziehbare Begründungen gibt.

Die letzten Schritte zu Predictive Costing

Um einem System ‚Intelligenz‘ beizubringen, braucht man zwei Dinge: einen geeigneten KI-Algorithmus und strukturierte Daten, um das System zu trainieren. Der Selbstlern-Algorithmus ist mittlerweile eine Ware, die für Softwareunternehmen relativ einfach zu produzieren ist. Spannender ist die Frage. wo und wie Künstliche Intelligenz am besten unterstützen kann und welche Schritte zum Erfolg noch notwendig sind. Selbst wenn die Technologie in den letzten Jahren große Fortschritte gemacht hat, gibt es immer noch Lücken zwischen dem, was heute möglich ist und dem, was für Predictive Costing benötigt wird. Eine Aufgabe wird es sein, die in die Tiefe gehenden, strukturierten Daten in flache Daten-Hierarchien zu transformieren. Produktkosteninformationen sind typischerweise strukturiert, da hier mit Stücklisten gearbeitet wird. Es ist es wichtig zu wissen, wo in der Stückliste ein bestimmter Wert zu finden ist: Ein Kilogramm Stahl kann vielleicht immer gleich viel kosten, es kann aber die Kosten des Produkts je nach Verarbeitung trotzdem unterschiedlich beeinflussen. Dies zu berücksichtigen und in die Kalkulationsprozesse einfließen zu lassen, ist eine der wichtigsten Notwendigkeiten im Zusammenhang mit KI. Sobald derartige Daten nicht in der Tiefe sondern flach strukturiert sind, kann künstliche Intelligenz ihre Wirkung entfalten und Ergebnisse liefern.