Engineering mit Rechenkraft beschleunigen

Am Supercomputer simuliert

Das Potential eines Supercomputers für die simulationsgestützte Produktentwicklung ist erheblich. Doch die Hürden vor einem Einsatz schrecken viele Unternehmen ab. Im Projekt HiPerSim4All wird an der Universität Bayreuth daran gearbeitet, den Zugang zu dieser Technologie zu vereinfachen und die dafür benötigte IT-Expertise auf Seite der Anwender zu senken.

Technische Simulationen, allen voran die Finite-Elemente-Analyse (FEA), ist seit Jahren Stand der Technik und wird in vielen Unternehmen in der Produktentwicklung eingesetzt. Der Bedarf einer realitätsnäheren virtuellen Abbildung von Produkten und Produktionsprozessen resultiert jedoch in einer zunehmenden Komplexität dieser Simulationen. Dadurch können die Rechenzeiten mehrere Tage dauern. Die Nutzung von Supercomputern bietet Möglichkeiten den Produktentwicklungsprozess effizienter zu gestalten und Entwicklungszeiten zu verkürzen. Jedoch ist der Einstieg keineswegs trivial. Daher begleiten Mitarbeiter der Universität Bayreuth im Rahmen des EU-geförderten Projekts ‚HiPerSim4All‘ Unternehmen bei der Umsetzung und unterstützen bei der Methoden- und Prozessentwicklung sowie dem Wissensaufbau der Mitarbeiter. Die neunte Ausgabe von Rockwell Automations „State of Smart Manufacturing“ Report liefert Einblicke in Trends und Herausforderungen für Hersteller. Dazu wurden über 1.500 Fertigungsunternehmen befragt, knapp 100 der befragten Unternehmen kommen aus Deutschland. ‣ weiterlesen

KI in Fertigungsbranche vorn

Workstations an der Grenze

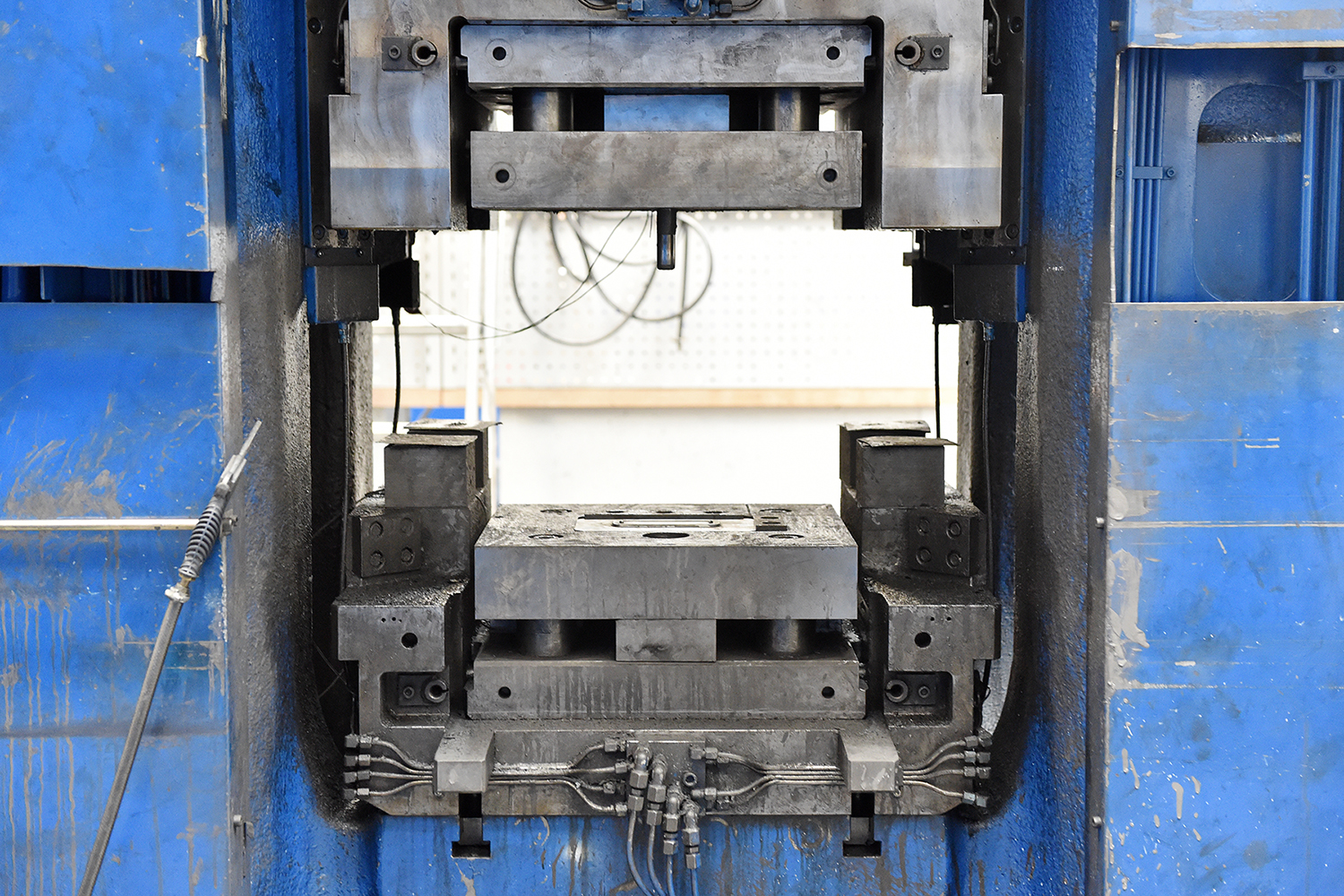

Zu den Projektpartnern des am Lehrstuhl für Konstruktionslehre und CAD (LSCAD) angesiedelten Projektes zählen vor allem kleine und mittelständische Unternehmen: Vom Ingenieurdienstleister bis hin zum OEM-Zulieferer. Die meisten der Projektteilnehmer setzen bei Simulationen auf aufgerüstete Workstations. Diese zeichnen sich meist durch mehrere Gigabyte große Arbeitsspeicher und schnelle Mehrkernprozessoren aus, was für kleine und mittelgroße Simulationen in der Regel ausreicht. Das Problem sind die immer häufiger gefragten großen und komplexen Simulationen. So werden Multi-Physik-Simulationen und das detaillierte Abbilden sehr großer Strukturen oft zu einem Problem, da entweder die Rechenzeiten unverhältnismäßig lang werden oder die Größe des verfügbaren Arbeitsspeichers limitierend wirkt. Die Gründe dafür liegen vereinfacht ausgedrückt am Skalierungsverhalten der FEA und den thermischen Eigenschaften der Prozessoren. Supercomputer können diese Limitationen überwinden und sind keinesfalls nur für Großunternehmen interessant. Der Thin[gk]athon, veranstaltet vom Smart Systems Hub, vereint kollaborative Intelligenz und Industrie-Expertise, um in einem dreitägigen Hackathon innovative Lösungsansätze für komplexe Fragestellungen zu generieren. ‣ weiterlesen

Innovationstreiber Thin[gk]athon: Kollaborative Intelligenz trifft auf Industrie-Expertise

Nicht nur für Konzerne

Bei einem Supercomputer handelt es sich im Grunde um mehrere unabhängige Computer (Rechenknoten), die über ein Hochgeschwindigkeitsnetzwerk verbunden sind und ein Cluster bilden. Jeder Rechenknoten ist wiederrum mit einem oder mehreren Multi-Core-Prozessoren bestückt, was eine Parallelisierung der Lösung auf mehreren Ebenen ermöglicht: Zunächst können Partitionierungsalgorithmen die ursprüngliche Problemstellung (Domain) in mehrere Subdomains aufteilen und diese über die verfügbaren Rechenknoten verteilen. Innerhalb jeder Subdomain kann wiederrum eine weitere Partitionierung durchgeführt und/oder eine Beschleunigung der mathematischen Operationen durch Ausnutzung des Parallelisierungspotentials der Prozessorkerne erreicht werden. Insbesondere bei der Dimensionierung und Auslegung von genormten Produkten mit unterschiedlichen Lastkollektiven können Unternehmen durch Simulationen mit Supercomputern Kosten sparen. Um einen Eindruck von den Chancen für die Produktentwicklung zu vermitteln, wurde am LSCAD der simulationsgestützte Auslegungsprozess eines elektrischen Antriebes hinsichtlich der thermischen Verlustleistung optimiert. Dies ist numerisch aufwendig, da die realistische Bestimmung des Temperaturprofils, sowohl einer Bestimmung der konvektiven Wärmeübergänge, als auch der abstrahlenden Wärme bedarf. Jedoch erfordert die Simulation der Strahlungsvorgänge eine sehr aufwendige Sichtfaktorbestimmung, die stark von der Kühlrippengeometrie abhängig ist und daher detailliert abgebildet werden muss und dementsprechend die Berechnungszeiten erhöht. Sollen dann noch viele Produktvarianten berechnet werden, kann das ohne einen Supercomputer unverhältnismäßig lange dauern.