Vom Prototypen zur Lösung

Raus aus der Proof-of-Concept-Hölle

Viele Unternehmen scheitern daran, die Prototypen ihrer Data-Analytics-Projekte in eine produktive, skalierbare Lösung zu überführen. Entscheidend dafür sind gute Planung und ein langer Atem, meint Danny Claus von DoubleSlash.

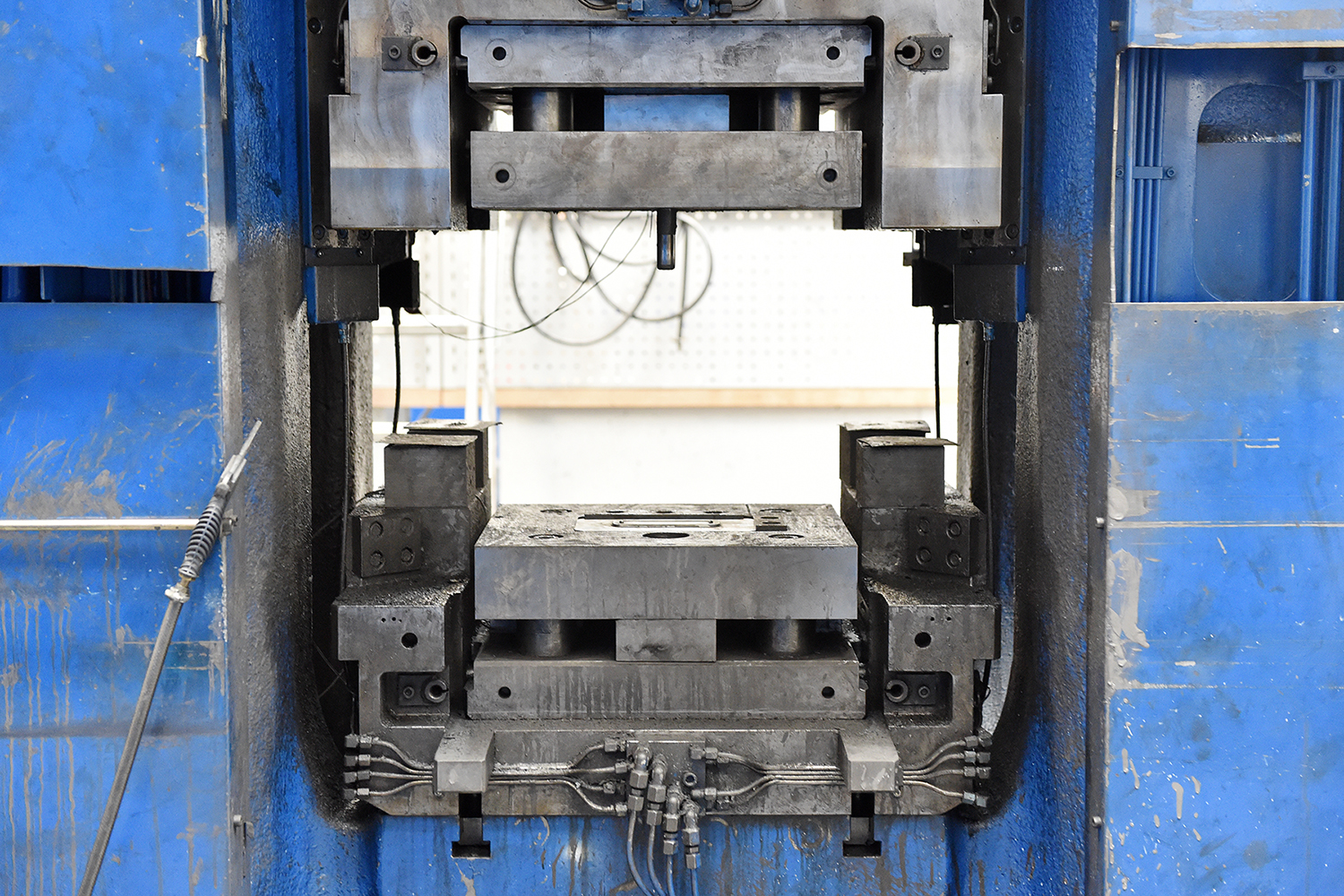

Machine Learning (ML) lebt davon, dass Daten in ausreichender Menge und Qualität zur Verfügung stehen, um die Algorithmen zu füttern, die dann Muster und Gesetzmäßigkeiten erkennen. Dies wiederum bildet die Basis dafür, dass Maschinen tatsächlich selbstständig lernen und ihre Funktion den Gegebenheiten anpassen können. Der Mangel an Daten – die auch in der erforderlichen Qualität vorliegen müssen – gilt als einer der größten Stolpersteine auf dem Weg zu einer ML-Lösung. Dabei gilt: Was als Proof of Concept funktioniert, ist noch lange nicht reif für den Einsatz in der Produktion. Die Herausforderungen und die Komplexität bei der Umsetzung von Data-Analytics-Projekten werden oft unterschätzt. Deshalb schaffen es bislang nur wenige Projekte tatsächlich in den produktiven Betrieb. Wer die Hürden nehmen will, muss gut und vor allem frühzeitig planen.

80 Prozent Datenintegration

Stehen die benötigten Daten gar nicht oder in nicht ausreichender Menge zur Verfügung, kann es sein, dass Maschinen und Anlagen entweder noch nicht mit den notwendigen Sensoren und Funktionen ausgestattet sind oder sie liefern nicht alle benötigten Informationen. Doch selbst wenn die Daten verfügbar sind, verteilen sie sich oft auf unterschiedliche Fachbereiche – isolierte Datensilos aber machen eine übergreifende Auswertung der Daten unmöglich. Für die Datenintegration sollten daher etwa 80 Prozent des Gesamtaufwands bei Data-Analytics-Projekten eingeplant werden. Bereits in einer sehr frühen Phase des Produktdesigns sollten die datentechnischen Voraussetzungen für Machine Learning betrachtet sowie anhand eines konkreten Use Cases definiert werden, welche Daten später benötigt werden. Im Anschluss empfiehlt es sich, möglichst viele Informationen zu übermitteln bzw. parallel zu klären, welche Technologien zum Einsatz kommen sollen. Beispielsweise stellt sich die Frage, ob der Einsatz von Cloud- und Big-Data-Technologien sinnvoll ist. Viele Anwendungen lassen sich auch mit einfacheren Methoden und Technologien umsetzen. So kommt man beispielsweise über den Einsatz simpler regel- oder schwellwertbasierter Verfahren und Visualisierungen mit BI-Dashboards schnell und deutlich günstiger ans Ziel.

Durchdachte Datenverwaltung

Für größere Unternehmen kann es sinnvoll sein, einen Data Lake zu schaffen, in dem Daten kontinuierlich zusammengeführt werden. Aufwand und Kosten dieser Herangehensweise sollten jedoch gegen den möglichen Mehrwert abgewogen werden. Allzu oft allerdings reichen Menge und Qualität der verfügbaren Daten – zumindest am Anfang – nicht aus, um das Projekt wirklich erfolgreich zu machen. Entweder sind Datenbestände unvollständig bzw. fehlerhaft oder sie decken nur einen kurzen Zeitraum ab. Daher sollte bereits in einer sehr frühen Projektphase geprüft werden, ob Datenqualität und -quantität ausreichen, um einen Use Case aufzubauen und die gesetzten Ziele zu erreichen. Reichen sie nicht, muss zunächst sichergestellt werden, ob, wie und bis wann die benötigten Daten zur Verfügung stehen. Es genügt nicht, mit dem Sammeln der Daten erst zu beginnen, wenn ein Machine Learning Projekt gestartet wird. Die neunte Ausgabe von Rockwell Automations „State of Smart Manufacturing“ Report liefert Einblicke in Trends und Herausforderungen für Hersteller. Dazu wurden über 1.500 Fertigungsunternehmen befragt, knapp 100 der befragten Unternehmen kommen aus Deutschland. ‣ weiterlesen

KI in Fertigungsbranche vorn

Miteinander reden

Nicht zu unterschätzen ist die Akzeptanz der verschiedenen Beteiligten, also etwa des Managements oder der potenziellen Anwender. Ein Ingenieur, der jahrelange Erfahrung darin hat, einen Fehler an einem Produkt oder einer Maschine zu erkennen, dürfte nicht begeistert sein, wenn ein Machine-Learning-Modell seine diesbezügliche Expertise ersetzt. Daher sollten die jeweiligen Stakeholder früh eingebunden werden. Dadurch können mögliche Probleme identifiziert und Gegenmaßnahmen entwickelt werden. Wichtig ist auch, die eigenen ethischen Prinzipien für den Umgang mit KI zu definieren, zu kommunizieren und letztendlich auch einzuhalten. Ebenso wichtig ist die Transparenz. Der Mehrwert eines solchen Projektes sollte beschrieben bzw. kommuniziert werden – finanziell und in Form von Verbesserungen für den Anwender bzw. Kunden.

Sorgfältige Vorbereitung

Die Integration eines Machine Learning Use Cases in der Produktion stellt hohe fachliche und organisatorische Anforderungen, die oft unterschätzt werden. Auswirkungen auf die Geschäftsprozesse kann dies auch später nach sich ziehen. Auch das Training vieler Mitarbeiter auf das neue System ist oft aufwendiger als gedacht. Häufig sind zudem die datenschutzrechtlichen Hürden sehr hoch – die damit verbundenen Klärungs- und Freigabeprozesse können langwierig sein. Gelegentlich müssen Kunden der Anpassung bestimmter Geschäftsprozesse zustimmen. Die Folge können unerwartet hohe Kosten oder zeitlicher Verzug sein. Daher sollten Datenschutzthemen frühzeitig in die Planungen miteinbezogen werden. Es stellt sich die Frage, welche Geschäftsprozesse wie angepasst werden müssen und welcher Aufwand damit verbunden ist. Wichtig ist auch eine rechtzeitige Wirtschaftlichkeitsbetrachtung: Welcher finanzielle Gewinn lässt sich im besten und im schlechtesten Fall erzielen und welche Kosten stehen dem gegenüber?

Passende Technologie wählen

Die Überführung eines PoC in die produktiven Prozesse ist technisch oft hoch komplex. Viele unterschiedliche Technologien müssen ineinandergreifen – was die Komplexität weiter erhöht. Cloudtechnologien könnten beispielsweise helfen, diese Komplexität zu reduzieren. Entscheidend hier ist auch, wie häufig und in welchem Umfang sich die Daten ändern. Denn davon hängt unter Umständen ab, wie oft das ML-Modell aktualisiert werden muss. Auch der Einsatz von Open-Source-Technologien kann sich als sinnvoll erweisen. Das Manufacturing Execution System (MES) HYDRA optimiert Produktionsprozesse für Fertigungsunternehmen, um Wettbewerbsvorteile zu erzielen. ‣ weiterlesen

MES-Integrator und 360-Grad-Partner für optimierte Fertigung

Vom Labor in die Praxis

Ein Prototyp ist schnell gebaut. Er entsteht unter idealisierten Laborbedingungen: Alle Daten sind verfügbar, Sonderfälle bleiben unbeachtet, potenzielle Kunden oder Nutzer sind außen vor. Ein ML-Projekt macht aber nur Sinn, wenn es im produktiven Umfeld echten Mehrwert generiert und von allen Betroffenen akzeptiert wird. Schon vor der Entwicklung eines PoCs sollte deshalb geklärt werden, welche Ziele im Praxiseinsatz angestrebt werden. Welche Hürden sind auf dem Weg zu erwarten und wie hoch werden sie voraussichtlich sein? Es lohnt sich unter Umständen, für die Beantwortung dieser Fragen und eine fundierte Business Case Betrachtung einen externen Spezialisten hinzuzuziehen. Fest steht, dass Data Science klassisches Software-Geschäft ist. Dessen Komplexität erfordert das Wissen einer ganze Reihe von Experten: Business- und IT-Consultants, Cloudentwickler, Big-Data-Experten, Softwareentwickler und mehr. Gelingt dieses Zusammenspiel der verschiedenen Akteure, dann hat das ML-Projekt gute Erfolgschancen. Bei Ergebnis winken spannende, innovative Produkte und Kunden, die von disruptiven neuen Methoden begeistert sind.

Einen Leitfaden für erfolgreiche Machine-Learning-Projekte gibt es auf der DoubleSlash-Website zum kostenlosen Download.