Spezialisten nach dem Co-Innovation-Prinzip verzahnen

KI und Edge kooperativ projektiert

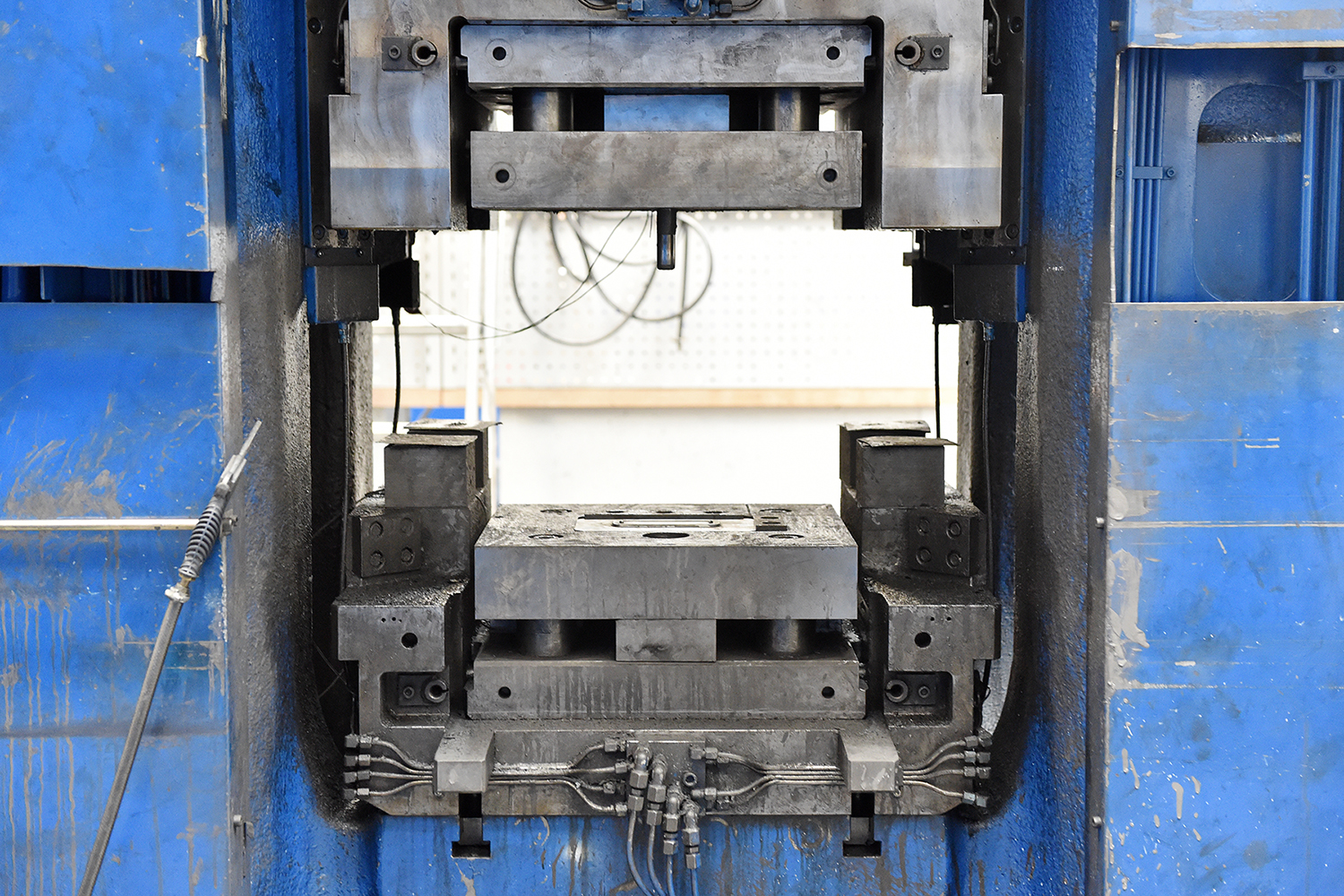

Durch Datenverarbeitung am Netzwerkrand können KI-Systeme in Echtzeit auf Anomalien im Maschinenpark reagieren und Kosten sparen. Um die Spezialisten für Hardware, Vernetzung, KI und weitere Software effizient zusammenzubringen, hat sich der Ansatz Co-Innovation bewährt.

Laut Grand View Research umfasste der Edge Computing-Weltmarkt im Jahr 2020 bereits 4,68 Milliarden Dollar und wird sich bis zum Jahr 2028 nahezu verzehnfachen. Die Entwicklung erklärt sich nicht zuletzt daraus, dass sich Edge-Konzepte als Schlüsseltechnologie für Digitalisierungsstrategien auf den Weg zur Industrie 4.0 herausgestellt haben. Viele Argumente sprechen dafür, sich weder völlig auf reine Cloud-Lösungen, noch allein auf eigene lokale Rechenzentren zu verlassen. Gerade wenn ein Unternehmen Aufgaben automatisieren, Produktivitätsreserven erschließen und resilienter gegen äußere und innere Störungen werden will.

Predictive Maintenance und integrierte Fertigung

Beispiele für Edge-Anwendungsszenarien sind der nachträgliche Ausbau eines Industriebetriebes hin zu einer – dezentral durch künstliche Intelligenz organisierten – Computerintegrierten Produktion (Computer Integrated Manufacturing, kurz CIM) oder die Integration vorausschauender Wartung (Predictive Maintenance, kurz PM). Beide Szenarien machen es in der Regel notwendig, Maschinen, Transportsysteme, Regeltechnik, Lose, womöglich auch einzelne Werkstücke mit eigener Sensorik und einem gewissen Maß an Eigenintelligenz nachzurüsten (Retrofit).

Einstieg mit günstiger Hardware

Damit dies möglich ist, wird die Software auf den Endgeräten ausgeführt und auch Daten werden auf den Devices gespeichert. Besonders leistungsfähige Hardware ist deshalb einer der Grundpfeiler für Edge Computing. Diese industrietauglichen Devices sind mittlerweile für niedrige dreistellige Beträge zu haben, was den Einsatz auch für kleinere Unternehmen rentabel macht. Die neunte Ausgabe von Rockwell Automations „State of Smart Manufacturing“ Report liefert Einblicke in Trends und Herausforderungen für Hersteller. Dazu wurden über 1.500 Fertigungsunternehmen befragt, knapp 100 der befragten Unternehmen kommen aus Deutschland. ‣ weiterlesen

KI in Fertigungsbranche vorn

Sichere Daten und kurze Latenzen

Vor allem in Zusammenspiel mit KI-Technologien, 5G-Vernetzung und dem Einsatz künstlicher neuronaler Netze auf Sensorsystem-Ebene sind durch den Edge-Ansatz Anwendungen möglich mit:

- kurzen Latenzzeiten, da die Signale geringe Distanzen zurücklegen,

- Echtzeit-Reaktion auf Anomalien,

- schneller Vorverarbeitung von Sensordaten,

- Entlastung des IT-Budgets, da nur bereits aggregierte Daten übertragen werden,

- höherer Ausfallsicherheit durch dezentrale Systeme,

- Datenhaltung auf dem Firmengelände,

- weniger Datenlast in den Netzen,

- Offline-Verfügbarkeit.

Um Edge-Infrastrukturen zu betreiben, gilt es für Produzenten jedoch einige Anforderungen zu adressieren. Sie müssen: Der Thin[gk]athon, veranstaltet vom Smart Systems Hub, vereint kollaborative Intelligenz und Industrie-Expertise, um in einem dreitägigen Hackathon innovative Lösungsansätze für komplexe Fragestellungen zu generieren. ‣ weiterlesen

Innovationstreiber Thin[gk]athon: Kollaborative Intelligenz trifft auf Industrie-Expertise

- lokale Infrastrukturen und IT-Kapazitäten errichten,

- einheitliche Schnittstellen, Daten- und Übergabeprotokolle in allen Ebenen des IoT-Stacks implementieren,

- dem Risiko von inkonsistenten und unsicheren Edge-Teillösungen begegnen.

Formen der Zusammenarbeit

Einige große IT-Anbieter können zwar Edge-basierte Lösungen aus einem Guss liefern. Als produzierendes Unternehmen darauf eigene Lösungen zu implementieren, kann jedoch durchaus viel Zeit kosten und andere Nachteile mit sich bringen. Viele Firmen setzen daher bei komplexen Edge-Konzepten in der Werkhalle auf Co-Innovationsprozesse mit kleineren IT-Unternehmen, auch um die Projekte zu beschleunigen. In dieser Form der Zusammenarbeit definieren Produzent und IT-Partner Funktionsmuster, Prototypen oder ein ‘Produkt mit minimalen Eigenschaften’ (MVP) zunächst gemeinsam. Vor allem mit Blick auf die Integration in die IT-Umgebung des Herstellers hilft es anschließend, die Aufgaben in einem Architektur-Schaubild zu visualisieren. Dieser ‘IoT Stack’ sollte die verschiedenen IoT-Technologieoptionen, die Schnittstellen, Geräte und Plattformen als Ebenen und Schichten darstellen und so die weitere Arbeit strukturieren helfen. In einem konkreten Fall (mehr dazu ab Seite 62) ging es um eine Infrastruktur zur vorausschauenden Wartung von Ventilen in einer Reinstwasser-Umgebung. Dort wurden folgende Ebenen erfasst und gegebenenfalls verschiedenen Projektbeteiligten zugeordnet:

- Sensor-Ebene – Vibrationssensoren und Miniatur-Mikrofone für die Erfassung der Ventilgeräusche

- Sensorsystem- und Edge-Ebene – die Sensorplattform eines Startups, die einen Teil der Edge-Intelligenz und KI-Algorithmen an Bord realisiert

- Datenübertragung – WLAN und Ethernet, auf 5G-Funk vorbereitet

- KI-Ebene – komplexere KI-Aufgaben und Analysen, von einer jungen Softwareschmiede hardwarenah geschrieben

- Visualisierungsebene – Dashboard eines großen Digitalunternehmens

- Cloudebene – Verknüpfung mit zentralen Clouddiensten, um die am Netzwerkrand vorverarbeiteten Daten sowie die Machine Learning-Algorithmen zu übertragen

Diese Art der Kooperation hat sich bewährt, um praxistaugliche Edge-Lösungen schnell auf den Weg zu bringen. Der Schlüssel liegt im passgenauen Mix an Spezialisten, die ein präzise konturiertes Projekt gemeinsam und zielstrebig nach vorne bringen.