KI-Projektierung richtig aufsetzen

Domänen- und Datenexpertise zusammenbringen

Häufig sollen IoT-Installationen in späteren Ausbaustufen KI-Applikationen mit verschiedenen Zielsetzungen aufnehmen. Doch viele Unternehmen scheitern daran, aus ihren KI-Projekten genug Mehrwert zu schöpfen. Dabei schützt Zusammenarbeit mit Spezialisten davor, bei der Datenanalyse in Fallen wie die Survivorship Bias zu tappen.

Im Zweiten Weltkrieg tüftelten Ingenieure der US Navy daran, wie sie die Abschüsse eigener Kampfflugzeuge reduzieren und so die Überlebensrate der Besatzungen erhöhen könnten. Eine Panzerung der kompletten Flugzeuge kam aus Gewichtsgründen nicht infrage. Die Konstrukteure entschlossen sich, die Flugzeuge dort mit Panzerplatten zu verstärken, wo die häufigsten Einschusslöcher zu finden waren. Der Erfolg blieb aus. Da die zusätzliche Panzerung an sich funktionierte, ahnten die Konstrukteure einen Fehler in ihrer Datenbasis. Sie beauftragten deshalb Adam Wald, einen rumänisch-amerikanischen Mathematiker. Dieser zog aus den Daten den Schluss, dass nicht die Stellen mit den meisten Einschusslöchern verstärkt werden mussten, sondern die Rumpfabschnitte mit den wenigsten Einschusslöchern. Denn dort getroffene Flugzeuge hatten es wohl überproportional häufig nicht zurück zum Stützpunkt geschafft und entzogen sich so der Datenanalyse. Der Erfolg gab dem Mathematiker recht.

Interdisziplinäre Teams

Das Beispiel von Adam Wald gilt vielen als Beleg, dass es für erfolgreiche datenbasierte Projekte zwei Expertenprofile braucht: Branchen- bzw. Produktspezialisten, die den Optimierungsbedarf erkennen und lösen, sowie Datenwissenschaftler (Data Scientists), die mit Daten umzugehen wissen. Doch noch heute kommen viele Data-Science-Projekte nicht über die Konzeptphase hinaus oder werden mangels Erfolg während der Umsetzung gestoppt, beobachtet Frank Müller in seiner Funktion als Director Data Science bei Infoteam Software. Das betrifft Projekte mit vergleichsweise einfachen Datenanalysen und -visualisierungen ebenso wie anspruchsvolle KI-Lösungen. „Unternehmen fragen uns häufig als Erstes, ob wir in ihrer Branche und bestenfalls auch in exakt ihrer Spezialdisziplin bereits Projekterfolge vorweisen können“, sagt Müller. Dabei sind Daten immer Daten – unabhängig von der Branche, in der sie erfasst werden. Viele komplett unterschiedlich klingende Anforderungen aus sehr verschiedenen Branchen lassen sich mit denselben Werkzeugen und Technologien lösen. Diese Zusammenhänge seien für Nicht-Datenwissenschaftler jedoch kaum erkennbar, schildert Müller.

Datenwissenschaftler im Team

Zwei Beispiele unterstützen diese Auffassung: Das erste betrifft die Ausfallvorhersage für Gerätekomponenten anhand von Temperatursensordaten. Das zweite beschreibt die Software, die telefonische Fehlermeldungen von Kunden inhaltlich vorsortiert und dem verantwortlichen Service-Techniker vergleichbare Meldungen inkl. Lösungsweg aus der Vergangenheit anbietet. Beide Aufgabenstellungen sind branchenunabhängig, klingen völlig verschieden und lassen sich doch auf eine ähnliche Datenstruktur reduzieren. In beiden Fällen bilden Zeitreihen einen entscheidenden Faktor, denn es geht darum, Muster in zeitlichen Abfolgen zu finden. Als Lösungsansatz kommen deshalb in beiden Beispielen Technologien zum Einsatz, wie sie auch beim ‚Natural Language Processing‘ (NLP), also in der Computerlinguistik verwendet werden. Der tatsächliche Unterschied und die Feinheiten beider Aufgabenstellungen liegen darin, auf die Individualität der Daten mit unterschiedlichen Werkzeugen aus dem Portfolio der statistischen Verfahren und dem maschinellen Lernen zu reagieren. Die neunte Ausgabe von Rockwell Automations „State of Smart Manufacturing“ Report liefert Einblicke in Trends und Herausforderungen für Hersteller. Dazu wurden über 1.500 Fertigungsunternehmen befragt, knapp 100 der befragten Unternehmen kommen aus Deutschland. ‣ weiterlesen

KI in Fertigungsbranche vorn

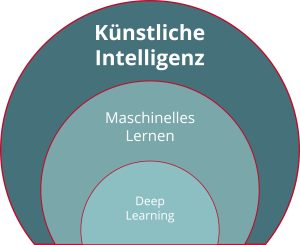

Schnittmengen der KI

Der häufig in diesem Zusammenhang verwendete Begriff ‚künstliche Intelligenz‘ ist nicht allgemeingültig definiert, sondern beschreibt lediglich eine Hard- oder Software, die in einer gewissen Art und Weise menschliches Verhalten imitiert. Ob dieses Verhalten auf klassisch programmierten Wenn-dann-Regeln basiert oder auf komplexeren Modellierungen, macht dabei keinen Unterschied. Eine Teilmenge der künstlichen Intelligenz ist das datenbasierte maschinelle Lernen, wozu auch Deep Learning mit tiefschichtigen neuronalen Netzen zählt. Es gliedert sich in drei Kategorien:

Supervised Learning (beaufsichtigtes Lernen) – Darunter fallen Input-Output-Paare, z.B. die Nutzungsart einer Maschine (Input) und die dazugehörige Temperaturentwicklung einer Maschinenkomponente (Output). Die KI beobachtet über einen längeren Zeitraum, wie Nutzungsart und Temperaturentwicklung zusammenhängen, und ist anschließend in der Lage, Temperaturentwicklungen vorherzusagen und darauf basierend auffällige Temperaturabweichungen zu erkennen. Der Thin[gk]athon, veranstaltet vom Smart Systems Hub, vereint kollaborative Intelligenz und Industrie-Expertise, um in einem dreitägigen Hackathon innovative Lösungsansätze für komplexe Fragestellungen zu generieren. ‣ weiterlesen

Innovationstreiber Thin[gk]athon: Kollaborative Intelligenz trifft auf Industrie-Expertise

Unsupervised Learning (unbeaufsichtigtes Lernen) – Hier untersucht eine KI ohne Vorwissen einen Datensatz dahingehend, ob Zusammenhänge erkennbar sind. Eine solche KI könnte beispielsweise einen bunt gemischten Haufen aus Dreiecken, Vierecken und Kreisen in verschiedene Cluster sortieren (Anzahl der Ecken, Größe, Farbe etc.). Spannend ist eine KI dieser Art für Daten, die ein Mensch aufgrund ihrer Komplexität nicht mehr analysieren kann.

Reinforcement Learning (bestärkendes Lernen) – Das KI-Modell trainiert sich selbst und wird im Erfolgsfall belohnt. Eine selbstlernende KI für das Spiel Vier gewinnt probiert unterschiedliche Vorgehensweisen und lernt aus Gewinnen und Verlieren. Das funktioniert im Zusammenspiel mit einem Menschen und bei manchen Konstellationen auch im Training gegen sich selbst. Auf diese Weise kann KI beispielsweise die Stromaufnahme von Maschinenparks optimieren.

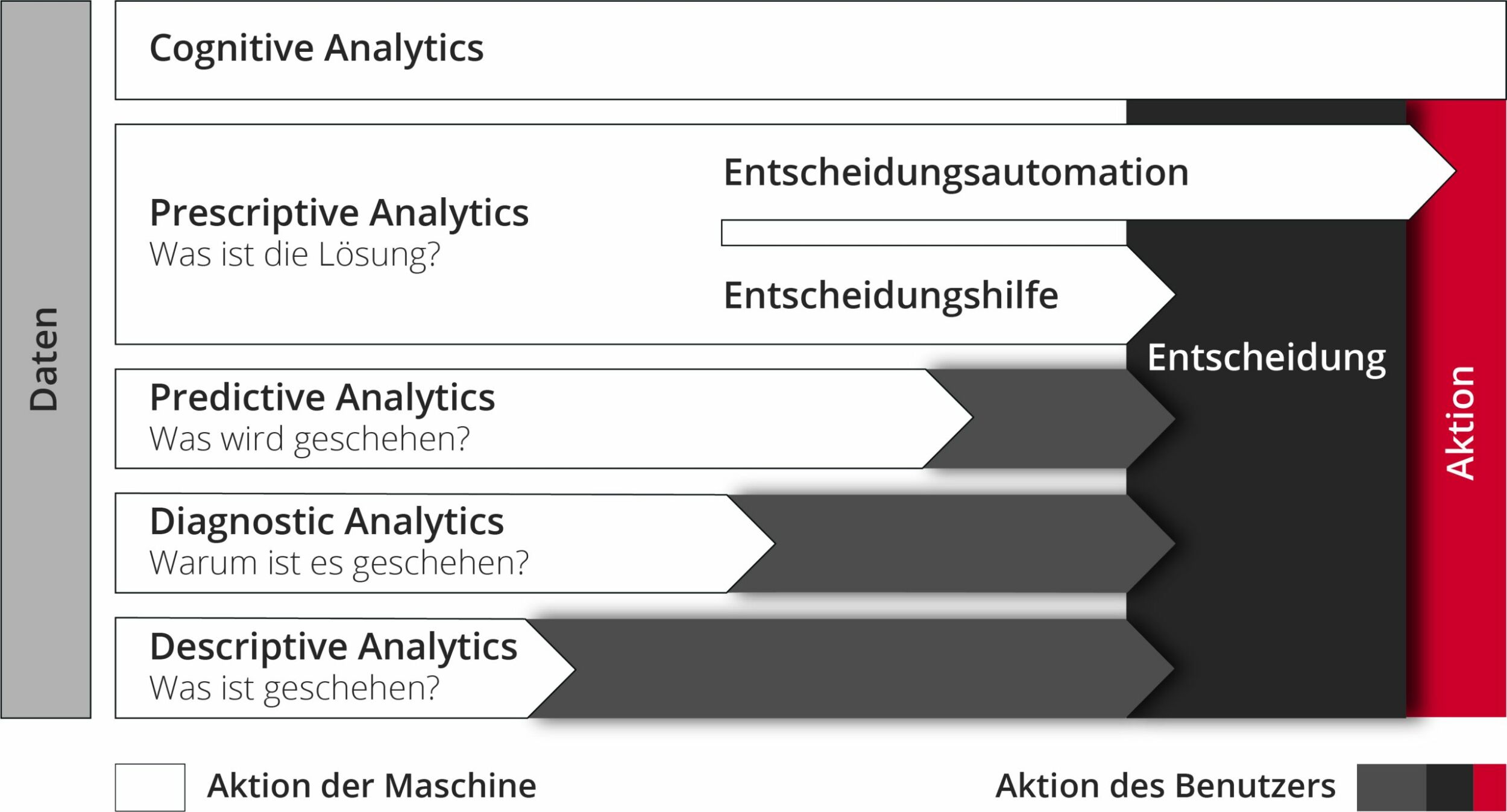

Data-Science-Projektablauf

Doch wie funktioniert in der Praxis der Weg vom Datenhaufen zur KI? „Schritt für Schritt“, lautet die Antwort von Frank Müller, „obgleich das große Ziel stets die Richtung vorgibt.“ Ein Ziel könnte beispielsweise eine Software sein, die den Ausfall von Gerätekomponenten vorhersagt, automatisiert Ersatzteile bestellt und den Technikereinsatz koordiniert. Im ersten Schritt beschäftigen sich die Datenwissenschaftler mit einer rein deskriptiven Bestandsaufnahme der verfügbaren Daten. Zusammenhänge zwischen Daten und eine Analyse, warum ein Ereignis eingetreten ist, entstehen im zweiten Schritt. Sobald die Ursachen bekannt sind, können die Datenwissenschaftler Modelle erstellen, die im dritten Schritt Vorhersagen ermöglichen. Darauf baut Schritt vier auf, der Handlungsempfehlungen anhand der Vorhersage ermöglicht. Diese Empfehlungen lassen sich im fünften Schritt automatisieren. Die Software bestellt beispielsweise das Ersatzteil und informiert den Service-Techniker. Ebenso ist auch eine automatisierte Abschätzung dahingehend möglich, ob der Techniker kurzfristig eine Wartung durchführen muss oder ob es ausreicht, wenn er die Reparatur im Zuge einer ohnehin geplanten Wartung in zwei Wochen durchführt. „Das Schöne an Data-Science-Projekten ist“, so Frank Müller, „dass wir jederzeit in Projekte einsteigen und sie anschieben können – ganz gleich auf welcher Stufe sie sich derzeit befinden.“ Ein Pluspunkt, den sich vor Jahrzehnten auch die US Navy in der Zusammenarbeit mit Adam Wald zu eigen machte. Die Militärexperten waren damals auf eine kognitive Verzerrung hereingefallen, die Statistiker heute als Survivorship Bias beziehungsweise Überlebenden-Verzerrung bezeichnen. Auch heute ist sie allgegenwärtig, beispielsweise wenn uns die Existenz alter Gebäude glauben lässt, früher sei die Bauqualität vergleichsweise höher gewesen. Tatsächlich handelt es sich jedoch lediglich um qualitativ oder ästhetisch hochwertige Gebäude, die seltener abgerissen und zugleich intensiver gepflegt werden als andere längst verschwundene Gebäude aus dieser Zeit.