Infrastruktur

Kein Edge Computing ohne Glasfaser

Die nächste Mobilfunkgeneration 5G gilt vielen als Ermöglicher für vernetzte Anwendungen wie autonomes Fahren und umspannende IIoT-Anwendungen. Diese Infrastrukturen werden aus einem Mix aus Edge, Fog und Cloud Computing geprägt sein. Dabei sollte nicht vergessen werden, dass Glasfaserverbindungen als Übertragungstechnik oft die erste Wahl darstellen.

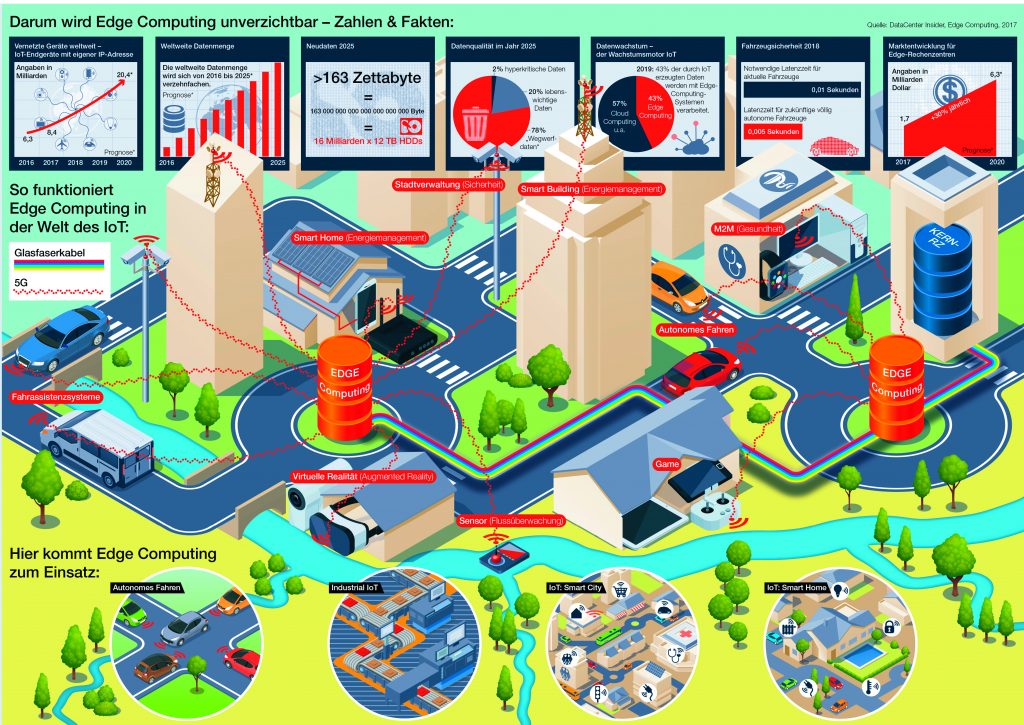

Prozesse im geschäftlichen Umfeld und in der Fertigung erfordern nicht nur immer mehr und differenzierte Daten. Vielmehr spielt deren Echtzeit-Verfügbarkeit und -Verarbeitung eine entscheidende Rolle. Entwicklungen wie IoT und IIoT tragen maßgeblich dazu bei, die Belastung konventioneller Rechenzentren zu steigern. Ein zu massives Datenvolumen führt im klassischen Rechenzentrum oft zu verzögerten Reaktionszeiten, denn von vielen verteilten oder mobilen Ressourcen sind die zentralen Knoten geografisch einfach zu weit entfernt, um noch vertretbare Latenzzeiten zu garantieren, wie sie für viele Abläufe erforderlich sind. Ähnliches gilt auch für die digitalisierten Verkehrskonzepte der Zukunft. Abhilfe sollen Fog- respektive Edge-Computing bieten. Unternehmen wird geraten, die zunehmende Datenflut bereits am Rande ihrer herkömmlichen Netzwerke zu zähmen, um die konventionellen Datacenter zu entlasten. Das wird notwendig sein, weil die Zahl der IoT-Devices in den kommenden Jahren weiter ansteigen wird. Die Analysten der Gartner-Group erwarten, dass bis 2020 weltweit rund 20,4 Milliarden IoT-Geräte im Einsatz sind, die über eine IP-Adresse miteinander kommunizieren. Hinzu kommen weitere physische Objekte, die sich über integrierte aktive oder passive Sensoren via Bluetooth, Laser oder Infrarot auch ohne IP ablesen lassen.

Am Entstehungsort verarbeitet

Autonome Fahrzeuge, Applikationen der Smart City, die auf Echtzeitdaten basieren oder mobiles IoT sind ohne Edge-Computing und 5G-Mobilfunk kaum zu realisieren. Manchmal reicht es, Sensordaten lediglich zusammenzuführen. Ein anderes Mal wiederum müssen sie anhand bestimmter Kriterien auch gefiltert werden. Und gelegentlich ist sogar die Kapazität eines Minirechenzentrums gefragt. Ein Beispiel dafür sind autonome Fahrzeuge. Beim selbstfahrenden Auto wird die gesamte Datenverarbeitung an Bord erledigt. Der Wagen muss innerhalb von Millisekunden reagieren können, etwa um Unfälle zu verhindern. Ohne Datenverarbeitung in Echtzeit nicht denkbar. Edge-Computing minimiert hier Latenzzeiten und verhindert Flaschenhälse im Datenfluss. Edge-Computing sorgt für die Echtzeitverfügbarkeit von Daten und schafft die Voraussetzungen für die Digitalisierung verteilter, kritischer Infrastrukturen. Durch den Brückenschlag zu den klassischen operativen Rechenzentrums-Technologien sowie zu Anwendungen in der Public Cloud können Unternehmen lokale Computerlösungen einsetzen, die sich je nach Bedarf beliebig skalieren lassen. Dies optimiert die Virtualisierung von Ressourcen und unterstützt Echtzeit-Anwendungen. Die neunte Ausgabe von Rockwell Automations „State of Smart Manufacturing“ Report liefert Einblicke in Trends und Herausforderungen für Hersteller. Dazu wurden über 1.500 Fertigungsunternehmen befragt, knapp 100 der befragten Unternehmen kommen aus Deutschland. ‣ weiterlesen

KI in Fertigungsbranche vorn

Mehr Flexibilität

Edge-Computer funktionieren in der Regel nicht isoliert, sondern müssen mit dem sogenannten Fog Computing kombiniert werden. Fog erweitert die Funktionalität von Edge-Computern, indem es die Cloud auf die lokale Ebene führt. Dabei werden sowohl zentralisierte als auch verteilte Computing-Ressourcen in einer Architektur kombiniert. So wird es möglich, dass Edge-Geräte miteinander und mit der zentralisierten Cloud kommunizieren. Das OpenFog-Konsortium sagt, dass die Fog-Architektur das Edge-Computing-Modell ideal ergänze, da sie ein Bindeglied bereitstellt, das notwendig ist, um Daten in die Cloud zu übertragen oder zu entscheiden, was lokal verarbeitet werden sollte. Erst im Zusammenspiel reduzieren Edge-Server und Fog-Server Latenzprobleme und optimieren die Reaktionsfähigkeit von Anwendungen. Dazu wird ein Großteil der Datenverarbeitung, -steuerung und -verwaltung von lokalen Applikationen in der unmittelbaren Nähe von Sensoren oder Geräten durchgeführt. Das beschleunigt die Echtzeitverarbeitung unternehmenskritischer Daten, wie sie beispielsweise notwendig sind, um Alarme oder Warnmeldungen auszulösen. Das kann der Fall sein, wenn kritische Situationen auftreten oder zeitnah die Wartung von Maschinen in der Produktion notwendig ist, um die Wertschöpfungskette nicht zu unterbrechen. Weniger kritische Dateninformationen werden – wie bisher – zur Verarbeitung und Analyse weiter an die Cloud oder das klassische Rechenzentrum übertragen. Der Thin[gk]athon, veranstaltet vom Smart Systems Hub, vereint kollaborative Intelligenz und Industrie-Expertise, um in einem dreitägigen Hackathon innovative Lösungsansätze für komplexe Fragestellungen zu generieren. ‣ weiterlesen

Innovationstreiber Thin[gk]athon: Kollaborative Intelligenz trifft auf Industrie-Expertise

Infrastruktur erweitern

Damit der Datenfluss ungebremst fließen kann, ist allerdings an vielen Stellen ein massiver Ausbau der Glasfaserinfrastruktur notwendig. Denn die Breitbandversorgung und der Aufbau zum Gigabit-Netz mit 5G ist die Voraussetzung für den produktiven Einsatz vieler IoT-Szenarien. Wesentlicher Bestandteil einer modernen Glasfaserinfrastruktur sind die Antennen der Mobilfunkmasten und Small-Cell Antennen bis hin zu Lichtwellenleiter-Verkabelungssystemen die zu den Rechenzentren hinführen und dort auch als interne Infrastruktur zum Einsatz kommen.

Glasfaser sichert Durchsatz

Außergewöhnliche Rechenleistungen erfordern eine entsprechende Infrastruktur. Dazu zählt gegebenfalls auch die Anbindung externer Niederlassungen. Von der Stange gibt es solche Lösungen aber nicht und Spezialisten wie Rosenberger OSI können Unternehmen bei der Implementierung ihrer Infrastrukuren unterstützen. Ergänzend zu Verbindungen mit Glasfaserkabeln kommen für Anwendungen wie autonomes Fahren oder ein IoT auch drahtlose Übertragungstechnologien zum Einsatz. Bei den Sendemasten für die drahtlose Datenübertragung setzt die Telekommunikationsindustrie bereits seit Jahren weltweit auf Fiber-to-the-Antenna (FTTA) Verkabelungssysteme, wie sie Rosenberger Site Solutions im Portfolio hat. Diese Technologie erfüllt hohe Anforderungen in Punkto Qualität und Zuverlässigkeit im Dauerbetrieb sowie eine hohe Resistenz gegen Umwelteinflüsse wie Hitze und Kälte sowie Temperaturschwankungen. Um den kontinuierlichen Datenaustausch, die Aktualisierung von Informationen und die Ausarbeitung notwendiger Handlungsempfehlungen zeitnah und konsistent zu garantieren, führt auf Sicht kein Weg an der 5G-Technologie vorbei. Und Lichtwellenleiter harmonieren in leistungsfähigen Infrastrukturen hervorragend mit dieser Funkinnovation.