Skalierbare Edge Computing-Infrastrukturen

Heute PoC, morgen die ganze Welt

Das IIoT erweitert zunehmend die IT- und Kommunikationsinfrastruktur von Produzenten. Dieser neue IT-Layer in der Fabrik wirkt sich dazu auf die Konzeption klassischer Automatisierungssysteme aus. Dabei stellen Anwender bereits mit der Systemauswahl für ihre PoCs die Weichen, wie schnell sich diese später skalieren lassen.

Der vielleicht einflussreichste Trend bei der Datenverarbeitung auf Werksebene ist, dass Edge-Computing die Trennung von Anwendungen und Infrastruktur ermöglicht. Eine Edge-Infrastruktur besteht aus Computer- und Netzwerkhardware, systemnaher Software und Diensten für das Lebenszyklus-Management von Infrastrukturkomponenten wie etwa Linux-basierten IIoT-Gateways. Edge-Anwendungen laufen auf Edge-Computern und -Gateways in der Nähe der industriellen Anlagen, die von ihnen überwacht und verwaltet werden. Wollen Automatisierungsingenieure digitale Lösungen auf Werksebene einrichten, sollten sie sich auf die Edge-Anwendungen konzentrieren und den Rest möglichst auslagern.

Kernkompetenz vs. auslagern

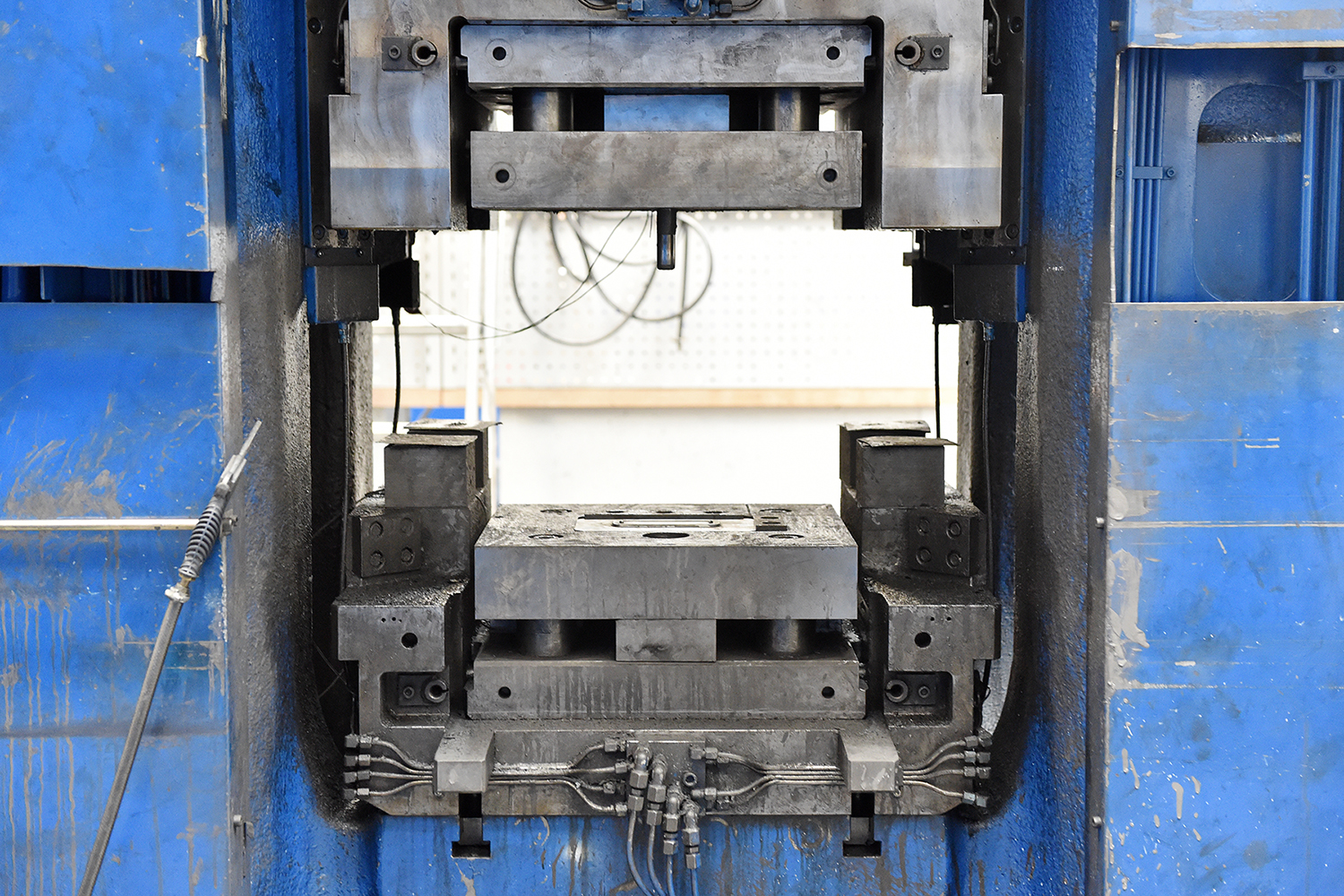

Die Kernkompetenz von Industrieunternehmen beinhaltet typischerweise einen Produktionsprozess physischer Güter. Kompetenzen bezüglich von Digitaltechnik, um diese Güter effizienter zu produzieren und zu betreiben, werden gerade aufgebaut. Oft machen diese digitalen Technologien auch neue und verbesserte Dienstleistungen möglich. Kernstück dieser neuen Möglichkeiten sind meist Daten. Diese Daten stehen entweder schon vor Ort zur Verfügung oder können über zusätzliche Sensoren oder eine geänderte Konfiguration beziehungsweise Programmierung vorhandener Komponenten aus den physischen Ressourcen und damit verbundenen Prozessen abgeleitet werden. Das Erfassen und Analysieren der Daten wird typischerweise als Kernkompetenz betrachtet, ebenso wie das Gewinnen von Erkenntnissen sowie die Entwicklung von Automatisierungslösungen auf Basis dieser Daten. Der Aufbau von Linux-basierten IIoT-Gateways und die Bereitstellung von Diensten für das Gerätelebenszyklus-Management sind meist die Kernkompetenz anderer Unternehmen, die sich auf die Installation von Edge-Infrastrukturen konzentriert haben. Viele derer Produkte und Dienste sind heute als Standardlösungen erhältlich. Die neunte Ausgabe von Rockwell Automations „State of Smart Manufacturing“ Report liefert Einblicke in Trends und Herausforderungen für Hersteller. Dazu wurden über 1.500 Fertigungsunternehmen befragt, knapp 100 der befragten Unternehmen kommen aus Deutschland. ‣ weiterlesen

KI in Fertigungsbranche vorn

Einfach, schnell und skalierbar

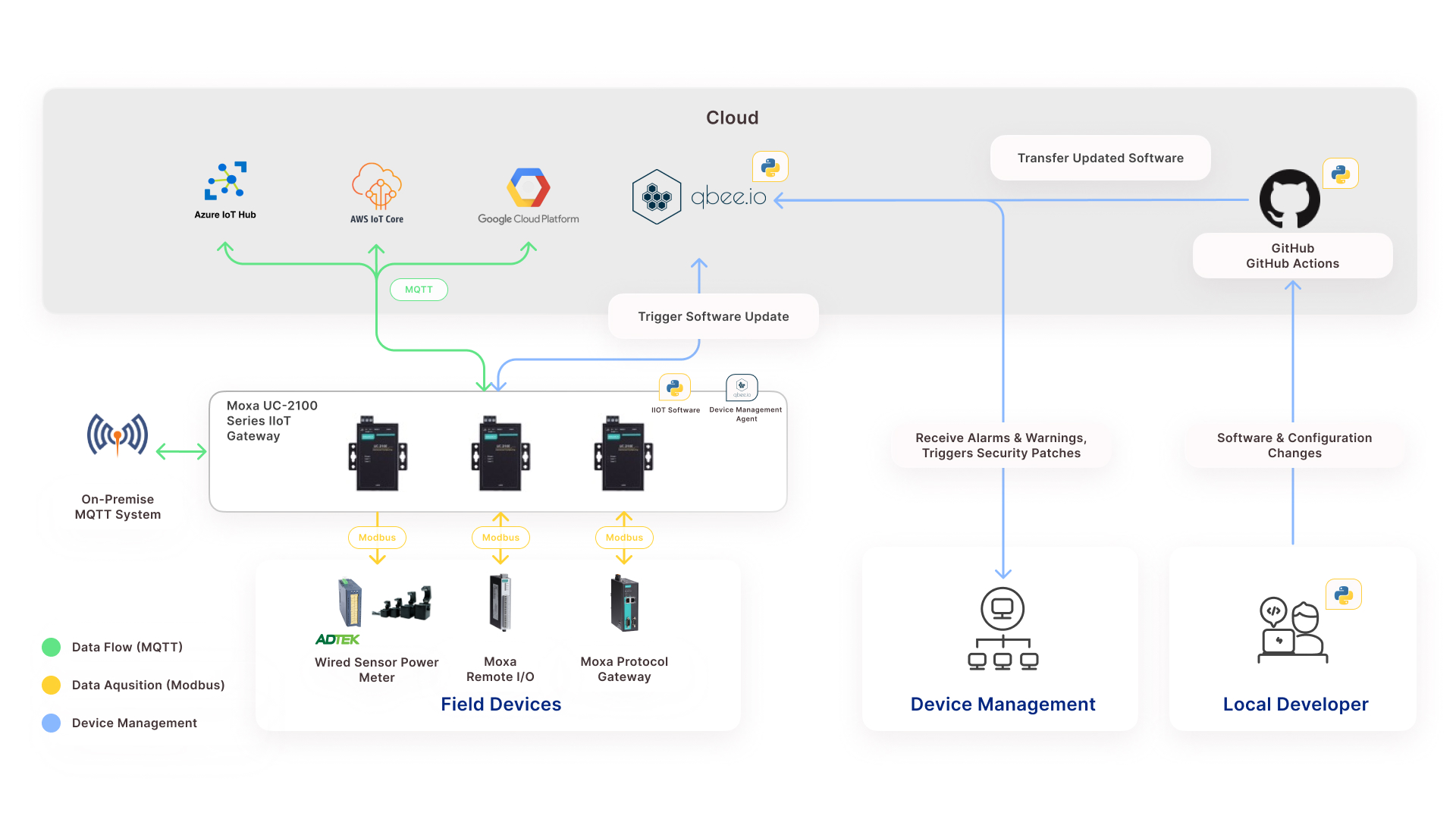

IIoT-Projekte beginnen typischerweise mit einer Machbarkeitsstudie oder einem Konzeptnachweis (Proof of Concept, PoC), wobei in kurzer Zeit Daten gesammelt werden müssen, um zu entscheiden, ob es sich lohnt, das Vorhaben fortzuführen oder nicht. Zugleich sollten möglichst viele der verwendeten Infrastrukturkomponenten nach erfolgreichem Abschluss der Machbarkeitsstudie problemlos in großem Maßstab bereitgestellt werden können. Anders ausgedrückt: Um später schneller skalieren zu können, sollte bereits der PoC auf der Edge-Infrastruktur laufen, die diese Skalierung unterstützt.

Softwareunabhängige Edge-Infrastruktur

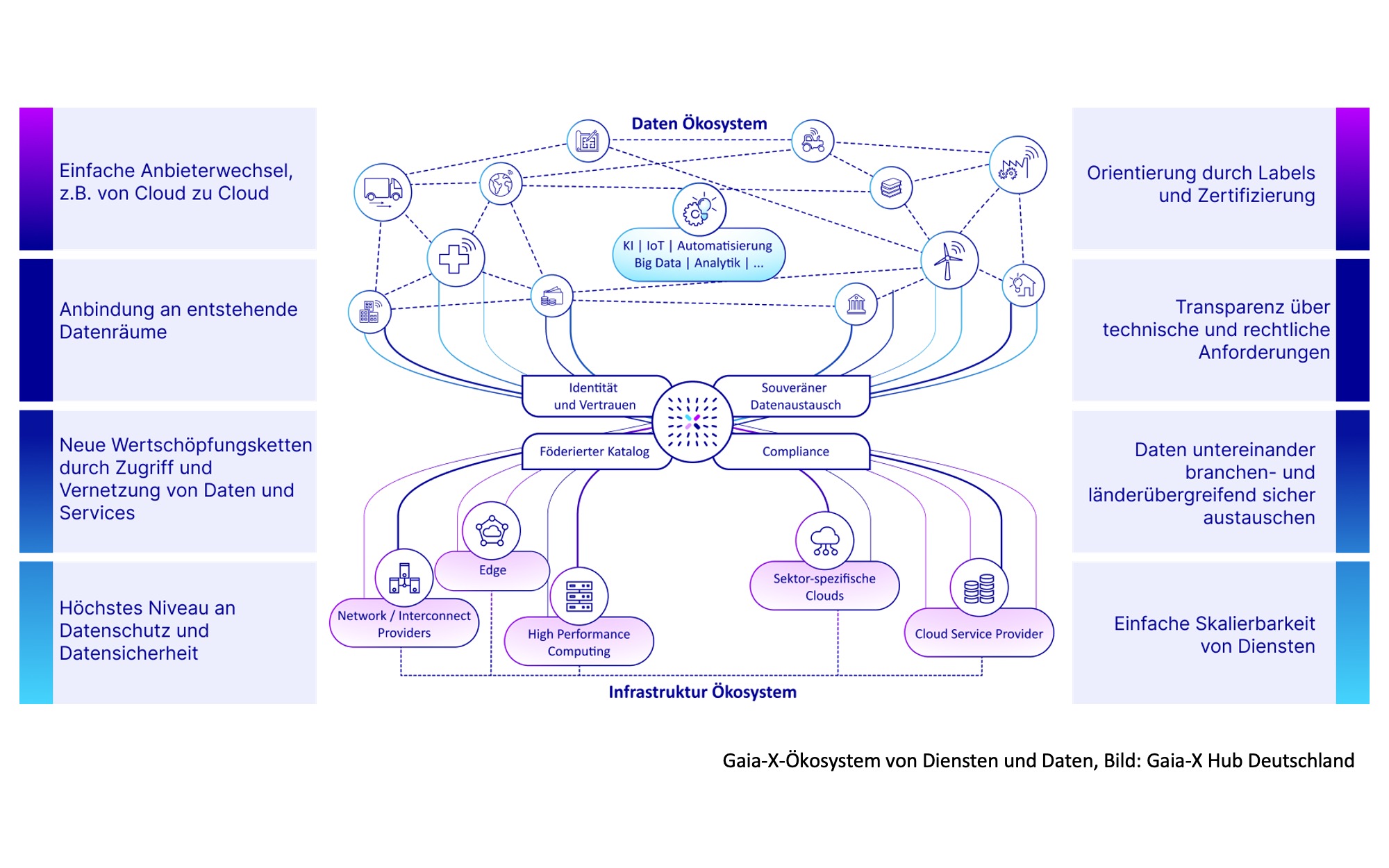

Es gibt mehrere Möglichkeiten zum Aufbau von Edge-Infrastrukturen, auf denen viele verschiedene Softwareoptionen ausgeführt werden können: Virtuelle Maschinen sind ein ziemlich altes Verfahren zur Trennung von Software und Hardware. Die Software-Containerisierung, mit der die Firma Docker Pionierarbeit geleistet hat, ist heute das häufigste Verfahren zur Bereitstellung, Aktualisierung und Entfernung von Software auf Hardware aller Art. Aber auch schlichte Linux-Software kann problemlos über Cloud-basierte Dienste für das Gerätelebenszyklus-Management bereitgestellt werden. Ein letzter Impuls hin zur Trennung von Edge-Infrastruktur und Edge-Anwendungen kommt von den Cloud-Hyperscalern Microsoft, Amazon und Google: Ihre Managementfunktionen für Hardware- und Software-Container im Edge-Bereich ermöglichen eine besonders einfache und schnelle Integration einer skalierbaren Edge-Infrastruktur in die Cloud und ins Rechenzentrum des Unternehmens. Der Thin[gk]athon, veranstaltet vom Smart Systems Hub, vereint kollaborative Intelligenz und Industrie-Expertise, um in einem dreitägigen Hackathon innovative Lösungsansätze für komplexe Fragestellungen zu generieren. ‣ weiterlesen

Innovationstreiber Thin[gk]athon: Kollaborative Intelligenz trifft auf Industrie-Expertise

Gemeinsames Datenmodell

Insbesondere für Umgebungen mit vielen unterschiedlichen Subsystemen und vielfältigen Datenquellen ist es wichtig, eine gemeinsame Betriebsumgebung für den neuen Satz von Edge-Anwendungen zu schaffen. Die größte Herausforderung besteht häufig in der Erstellung eines gemeinsamen Datenmodells. Werden Anwendungen für eine bestimmte Rohdatenquelle entwickelt, ist es schwierig, sie an anderen Stellen wiederzuverwenden. Zum Erstellen eines gemeinsamen Datenmodells gehört die Umwandlung von Daten, beispielsweise vom Modbus-Rohdatenformat in das strukturierte MQTT/JSON-Format. Dieses strukturierte Format muss eine feste Syntax und eine definierte Bedeutung (Semantik) aufweisen, die unabhängig vom Gerät sind und über die jeweilige Anwendung hinaus gelten. Auf diese Weise kann es von möglichst allen aktuellen und künftigen Edge-Anwendungen verwendet werden, selbst wenn mit der Zeit viele weitere Geräte hinzugefügt werden. Die Konvertierung zwischen dem Rohdatenformat und dem neuen gemeinsamen Datenmodell erfolgt über einfache Softwaremodule, die für die Verständigung zwischen den beiden Welten sorgen. Mit einem gemeinsamen Datenmodell können sich die Entwickler auf die Geschäftslogik ihrer Edge-Anwendungen konzentrieren und brauchen sich nicht mehr mit der komplizierten Bytestruktur der Modbus-Register auseinanderzusetzen, was ihre Produktivität erheblich steigert.

Tools erleichtern Umsetzung

Die praktische Umsetzung des Konzepts muss sich an den Anforderungen und Möglichkeiten der Unternehmen orientieren: ein kleines Unternehmen ohne große IT-Abteilung und -Budget wird eher ein kompaktes IIoT-System mit viel Open Source und etwas Eigenentwicklung für ganz spezifische Anwendungsfälle aufbauen. Größere Unternehmen finden mit Microsofts Azure IoT Architektur und Ökosystem an Partnern eine Lösung für jede innovative Idee.