Artificial Intelligence of Things

Edge-Hardware für jede Phase des KI-Projekts

Edge-Computing-Ebenen

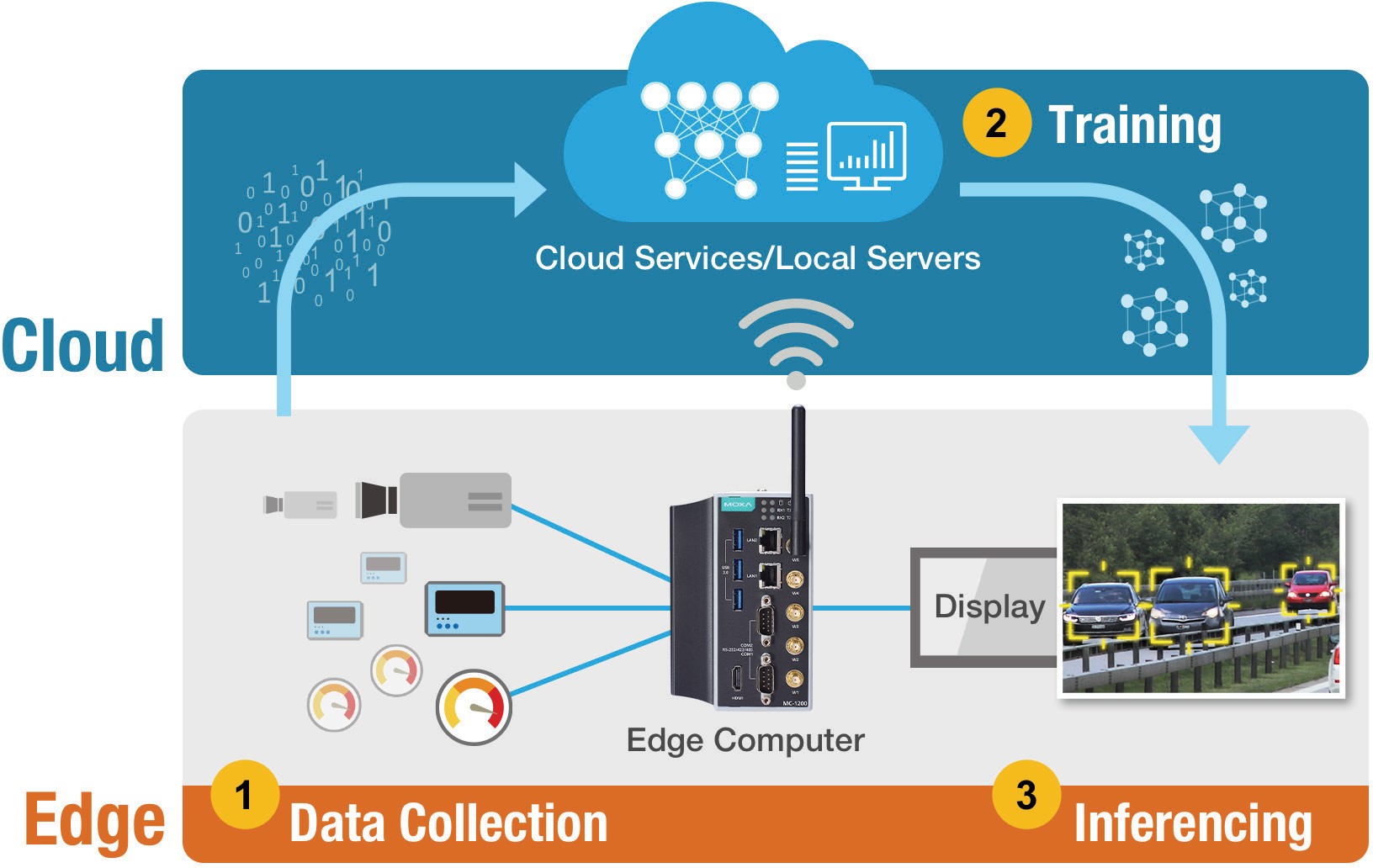

Obwohl die KI immer noch hauptsächlich in der Cloud oder auf lokalen Servern traininert wird, finden die Datenerfassung und das Inferencing notwendigerweise am Netzwerk-Rand statt. Da das Inferencing die Phase ist, in der das trainierte KI-Modell die meiste Arbeit leistet, um die Anwendungsziele zu erreichen – also Entscheidungen zu treffen oder Aktionen auf der Grundlage neu erfasster Felddaten durchzuführen – muss zur Auswahl des passenden Prozessors festgelegt werden, welche der folgenden Edge-Computing-Ebenen benötigt werden:

Untere Edge-Computing-Ebene – Das Übertragen von Daten zwischen Edge und Cloud ist teuer, zeitraubend und führt zu Latenzzeiten. Beim Low-Edge-Computing wird nur eine kleine Menge an Nutzdaten an die Cloud gesendet, was die Verzögerungszeit, die Bandbreite, die Datenübertragungsgebühren, den Energieverbrauch und die Hardwarekosten reduziert. Eine ARM-basierte Plattform ohne Beschleuniger kann auf IIoT-Geräten verwendet werden, um Daten zu erfassen und zu analysieren, um so schnelle Schlussfolgerungen zu ziehen oder Entscheidungen zu treffen.

Mittlere Edge-Computing-Ebene – Diese Inferencing-Ebene kann verschiedene IP-Kamerastreams für die computergestützte Bildverarbeitung oder Videoanalyse mit ausreichenden Verarbeitungsbildraten abwickeln. Das Medium-Edge-Computing umfasst ein breites Spektrum an Datenkomplexität auf der Grundlage des KI-Modells und der Leistungsanforderungen des Anwendungsfalls wie der Gesichtserkennung für ein Büro-Eingangssystem, verglichen mit einem großen öffentlichen Überwachungsnetz. Bei den meisten industriellen Edge-Computing-Anwendungen müssen außerdem Aspekte wie ein begrenztes Energiebudget oder ein lüfterloses Design zur Wärmeableitung berücksichtigt werden. So können auf dieser Ebene möglicherweise eine Hochleistungs-CPU, eine GPU der Einstiegsklasse oder eine VPU verwendet werden. Beispielsweise stellen die CPUs der Serie Intel Core i7 eine effiziente Computer-Vision-Lösung mit dem OpenVino-Toolkit und softwarebasierten KI-/ML-Beschleunigern dar, die das Inferencing auf Edge-Ebene durchführen können.

Obere Edge-Computing-Ebene – Beim High-Edge-Computing werden größere Datenmengen für KI-Expertensysteme verarbeitet, die mit einer komplexeren Mustererkennung arbeiten, beispielsweise für die Verhaltensanalyse bei der automatischen Videoüberwachung in öffentlichen Sicherheitssystemen, mit der Sicherheitsvorfälle oder potenziell bedrohliche Ereignisse erkannt werden können. Beim Inferencing auf der oberen Edge-Computing-Ebene werden meist Beschleuniger verwendet, darunter High-End-GPUs, VPUs, TPUs oder FPGAs, die mehr Leistung (200 Watt oder höher) verbrauchen und Abwärme erzeugen. Da der erforderliche Energieverbrauch und die erzeugte Wärme die Grenzwerte am entfernten Rand des Netzwerks überschreiten können, werden High-Edge-Computersysteme häufig an randnahen Standorten eingesetzt. Die neunte Ausgabe von Rockwell Automations „State of Smart Manufacturing“ Report liefert Einblicke in Trends und Herausforderungen für Hersteller. Dazu wurden über 1.500 Fertigungsunternehmen befragt, knapp 100 der befragten Unternehmen kommen aus Deutschland. ‣ weiterlesen

KI in Fertigungsbranche vorn

Entwicklungstools

Für verschiedene Hardware-Plattformen stehen mehrere Tools zur Verfügung, die den Prozess der Anwendungsentwicklung beschleunigen oder die Gesamtleistung für KI-Algorithmen und maschinelles Lernen verbessern.

Frameworks für Deep Learning

In Betracht kommt die Verwendung eines Deep-Learning-Frameworks, das heißt einer Oberfläche, einer Bibliothek oder eines Tools, mit dem sich Deep-Learning-Modelle einfacher und schneller erstellen lassen, ohne dass man sich mit den Details der ihnen zugrunde liegenden Algorithmen auseinandersetzen muss. Deep-Learning-Frameworks bieten eine klar umrissene Möglichkeit zur Definition von Modellen unter Verwendung einer Sammlung von vorgefertigten und optimierten Komponenten. Die drei beliebtesten sind: Der Thin[gk]athon, veranstaltet vom Smart Systems Hub, vereint kollaborative Intelligenz und Industrie-Expertise, um in einem dreitägigen Hackathon innovative Lösungsansätze für komplexe Fragestellungen zu generieren. ‣ weiterlesen

Innovationstreiber Thin[gk]athon: Kollaborative Intelligenz trifft auf Industrie-Expertise

PyTorch – PyTorch wurde in erster Linie von Facebook entwickelt und ist eine Open-Source-Bibliothek für maschinelles Lernen, die auf der Torch-Bibliothek basiert. Die freie und quelloffene Software wurde unter der modifizierten BSD-Lizenz veröffentlicht und wird für Anwendungen wie Computer-Vision und die Verarbeitung von natürlicher Sprache eingesetzt.

TensorFlow – Ermöglicht schnelles Prototyping, Forschung und Produktion mit den benutzerfreundlichen Keras-basierten APIs von TensorFlow, die zum Definieren und Trainieren neuronaler Netzwerke verwendet werden.

Caffe – Caffe zeichnet sich durch seine Architektur aus, mit der sich Modelle und Optimierungen ohne harte Codierung definieren und konfigurieren lassen. In Caffe kann ein einzelnes Flag gesetzt werden, um das Modell auf einer GPU-Maschine zu trainieren und es dann auf Warenclustern oder mobilen Geräten zu implementieren.