Predictive Quality

MES für zukunftsgewandtes Qualitätsmanagement

Beim traditionellen Qualitätsmanagement werden gefertigte Bauteile analysiert, um die Qualität der nächsten zu verbessern. Beim Predictive Quality-Ansatz wollen Hersteller analysegestützt eine höhere Qualität erzielen, ohne in die Vergangenheit schauen zu müssen. Bereits verfügbare Lösungen für den Ansatz integrieren die erforderlichen Daten auf einer MES-Plattform.

Der Blick in den Rückspiegel beim herkömmlichen Qualitätsmanagement ist aufwendig und verursacht hohe Kosten. Jedes Ausschussteil verringert die Produktivität und auch die KVP-Initiativen zur Qualitätssteigerung von Produkten und Fertigungsprozessen erfordert laufend Zeit- und Personaleinsatz. Wüssten jedoch Fertigungsplaner, Schichtleiter oder Werker schon im laufenden Fertigungsprozess, wie die Produktqualität ausfallen wird, könnten sie rechtzeitig Maßnahmen ergreifen, um sich anbahnende Abweichungen zu korrigieren, bevor es zu Ausschussteilen kommt. Hier setzt Predictive Quality an.

Das digitale Abbild

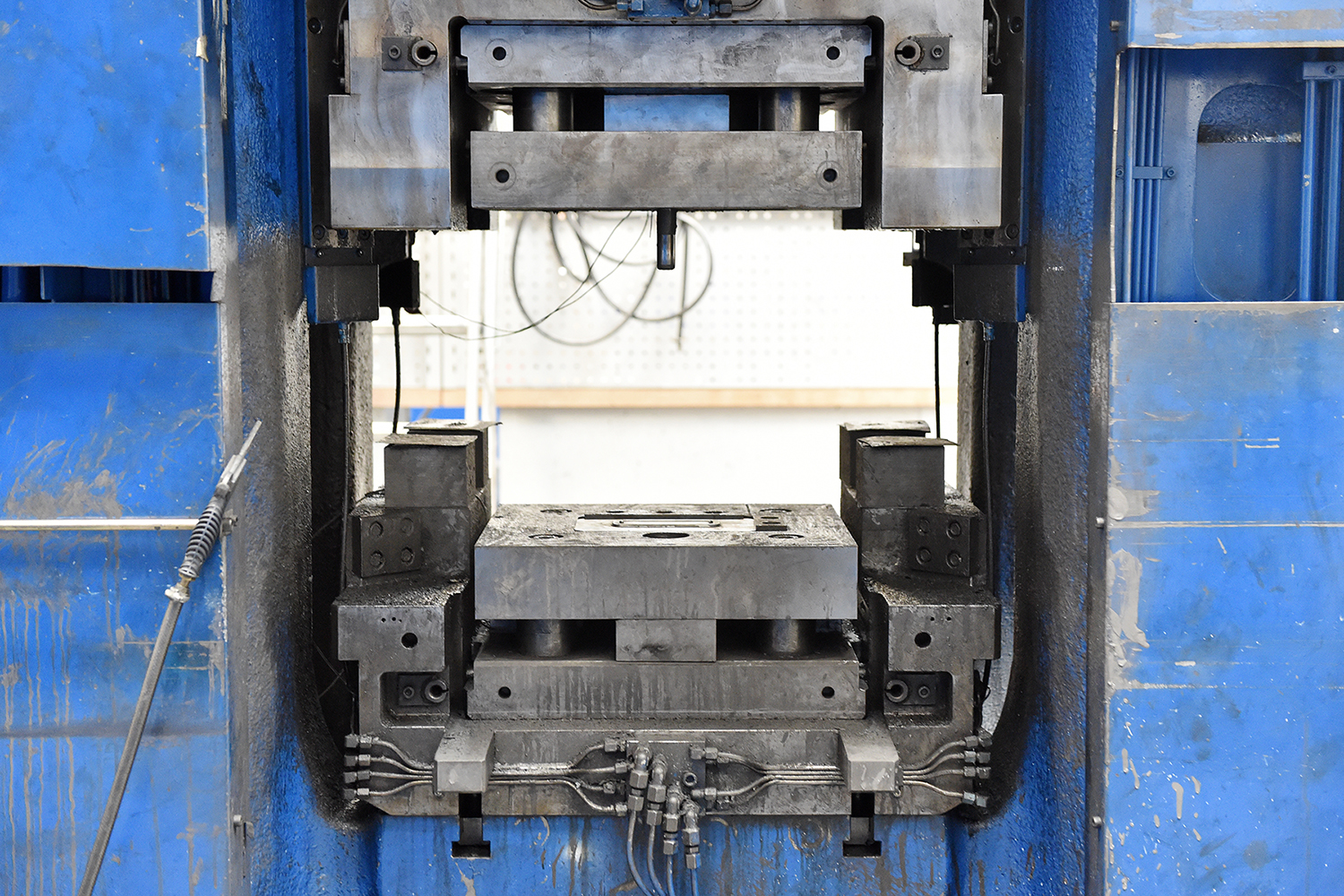

Angenommen ein Unternehmen aus der Kunststoffindustrie produziert täglich eine hohe Zahl Kleinteile, die ausgeliefert und weiter verbaut werden. Die Produktqualität wird anhand einer Quality Rate (PPM) ermittelt. Dies zu kontrollieren, ist aufwendig und für höhere Transparenz müsste die Frequenz der Qualitätskontrollen erhöht werden, wodurch der Aufwand weiter steigt. Die Qualitätskontrolle wird durch den Kosten-Nutzen-Faktor limitiert. Predictive Quality soll dieses Spannungsfeld zwischen qualitativen Anforderungen und Kosten aufbrechen, indem zur Qualitätsanalyse historische Produkt- und Prozessdaten in Echtzeit herangezogen und extrapoliert werden. So kann anhand produkt- und prozessspezifischer Daten ein digitales Abbild entstehen, das permanent überwacht wird, um Abweichungen zu erkennen. Die datengetriebene Qualitätsprognose dient als Grundlage für die Entscheidungen von Fertigungsplanern und Schichtleitern. Maschinenbediener können in den laufenden Fertigungsprozess eingreifen, statt die Qualität eines Teils am Prozessende nachzuprüfen. Die neunte Ausgabe von Rockwell Automations „State of Smart Manufacturing“ Report liefert Einblicke in Trends und Herausforderungen für Hersteller. Dazu wurden über 1.500 Fertigungsunternehmen befragt, knapp 100 der befragten Unternehmen kommen aus Deutschland. ‣ weiterlesen

KI in Fertigungsbranche vorn

Muster erkennen

Mit künstlicher Intelligenz lassen sich aus historischen Daten Vorhersagen über die zukünftige Produkt- und Prozessqualität ableiten. So kann aus einer beschreibenden eine vorhersagende Analyse werden. Dafür rechnen Computer die Daten von digitalen Abbilder statistisch hoch, um Muster zu erkennen, die auf künftige Qualitätsabweichungen hinweisen. An diesen Hochrechnungen wurde im Projekt Quality Data based Risk Assessment for Industry 4.0 (Quadrika) geforscht, an dem auch der MES-Hersteller GBO Datacomp beteiligt war. Im Rahmen dieses vom Bundesforschungsministerium geförderten Projekts wurde ein Quality-Data-Modul (QDM) entwickelt, das als Addon eines MES Prozesse online überwacht, um Prozess- und Produktrisiken zu vermeiden, bevor sie auftreten. Dadurch sollen Prozess- und Produktqualität verbessert und Ausschüsse reduziert oder wenigstens früh ausgeschleust werden.

Realistisches Bild entwickeln

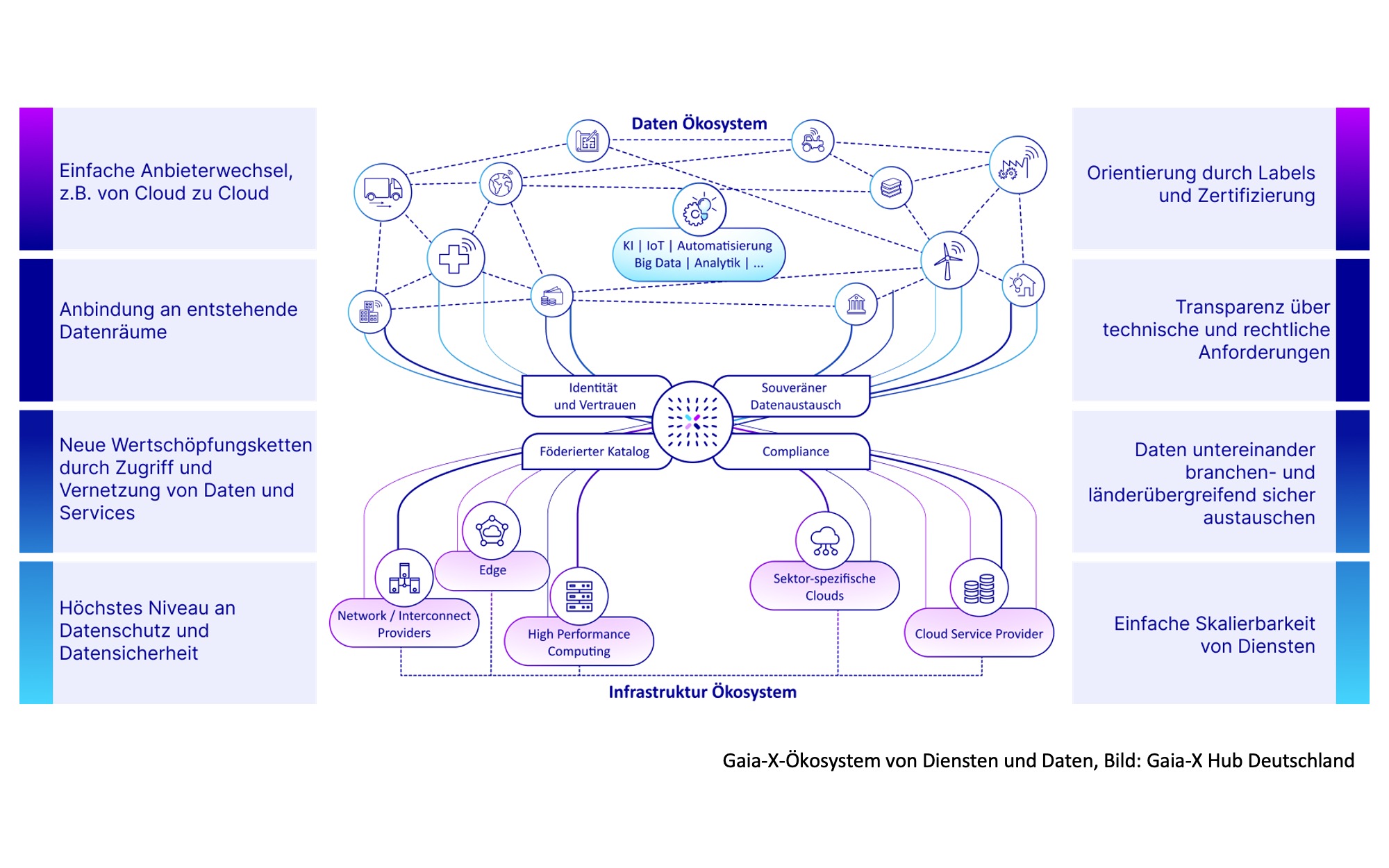

Ohne einen Onlineaustausch von Daten ist Predictive Quality aktuell unmöglich. Je mehr, desto besser: Mit einem steigenden Grad an Realismus des digitalen Abbilds steigt die Wahrscheinlichkeit für zutreffende Qualitätsprognosen. Dafür müssen nicht nur das zu fertigende Produkt anhand zahlreicher Daten digital abgebildet werden, sondern auch die einzelnen Fertigungsprozesse. Dazu braucht es Daten wie über die Verfügbarkeiten von Maschinen, Werkzeugen, Rüstzeiten, Temperaturen, Geschwindigkeiten, Drücken und so weiter. Viele produzierende Unternehmen speichern solche Daten bereits, oft aber in einzelnen Anwendungen. So liegt die Herausforderung weniger in der Größe der Datenmenge, als in ihrer Auswahl, der Aufbereitung und der Datenintegration.

Fertigungstechnik mitdenken

Die Prozessqualität ist eine wichtige, aber nicht die einzige Voraussetzung für eine hohe Produktqualität. Die angewendete Fertigungstechnologie kann ebenfalls auf die Produktqualität einwirken, auch wenn alle Prozesswerte bestmöglich eingestellt sind. Und natürlich existieren weitere externe Faktoren, die die Prozess- und Produktqualität beeinflussen. Mit Predictive Quality können diese Einflüsse ebenfalls berücksichtigt werden. Das Zielbild Industrie 4.0 fußt auf der horizontalen und vertikalen Datenintegration, auch unter dem Begriff Internet of Production (IoP) bekannt. Im Idealfall ist jeder Unternehmensbereich mit allen anderen Bereichen vernetzt, bis hin zu Kunden und Lieferanten. Angesichts dieser Vorstellung rückt die Rolle der Datenintegration weiter Richtung Zentrum. Aber nicht nur aus dieser gesamtheitlichen Betrachtung ist eine hochwertige Datenintegration ein wichtiger Punkt, bevor Predictive Quality angewendet werden kann. Wie bei allen Prognosen nimmt auch hier die Güte der Vorhersage für die Prozess- und Produktqualität ab, je weiter die Prognosen in die Zukunft reichen. Um es bildhaft auszudrücken: Es ist einfacher, den Sieger eines Pferderennens zehn Meter vor dem Ziel vorherzusagen, als am Start. Aber je länger der Prognosehorizont ist, desto einfacher ist es, auf Qualitätsabweichungen zu reagieren (oder: Zehn Meter vor dem Ziel können keine Pferdewetten mehr abgeschlossen werden). Unternehmen müssen das Spannungsfeld zwischen Prognosehorizont und -güte austarieren, um Spielraum für Reaktionen zu erhalten. Das Manufacturing Execution System (MES) HYDRA optimiert Produktionsprozesse für Fertigungsunternehmen, um Wettbewerbsvorteile zu erzielen. ‣ weiterlesen

MES-Integrator und 360-Grad-Partner für optimierte Fertigung

Erfahrung mit Datenintegration

Ein passend integriertes MES ist eine gute Grundlage für die Nutzung von Predictive Quality. Je mehr Daten im System vorhanden sind, desto präziser ist das digitale Abbild und damit auch die Qualitätsvorhersage. Aber auch hier ist die Menge an Daten nicht der einzige Faktor. Die unterschiedlichen Daten aus zahlreichen Quellen müssen vereinheitlich und miteinander verknüpft werden. Die GBO Datacomp kann in solchen Projekten einerseits auf die Erfahrungen aus dem Forschungsprojekt Quadrika und andererseits auf das Knowhow aus zahlreichen MES-Implementierungen zurückgreifen. Mit der Anwendung bisoft MES verfügt der Anbieter über eine Datenplattform, die unabhängig von vorhandenen QM-Lösungen Daten sammelt, verdichtet und visualisiert, um daraus anhand präskriptiver Analysen Qualitätsprognosen in Echtzeit zu entwickeln, die im laufenden Fertigungsprozess zur Verfügung gestellt werden.

Modulare Lösung

Horizontale und vertikale Datenintegration ist nicht von heute auf morgen erreicht. Daher ist das MES des Systemanbieters modular aufgebaut, um als Integrationsplattform anhand jeweiliger Anforderungen zu skalieren. Auf diese Weise können etwa nach einer Test-Fertigungslinie weitere Linien sukzessive in die Plattform integriert werden. Ebenso lassen sich Schritt für Schritt immer mehr Daten, auch aus Unternehmensbereichen abseits der Produktion, integrieren, um die Genauigkeit des digitalen Abbilds und damit der Vorhersagen zu erhöhen. Letztendlich können die Vorteile der Predictive Quality nicht nur in der Fertigung zum Tragen kommen, sondern überall dort im Unternehmen, wo die Prozessqualität gesteigert werden soll.